[카테고리:] Prompt/Context Engineering

-

* Prompt Compression for Large Language Models: A Survey (NAACL 2025)

1. 핵심 문제의식 (Why Prompt Compression?) LLM 사용 시 가장 큰 병목 중 하나는 긴 prompt입니다. 따라서 목표는: “성능 유지하면서 prompt 길이 최소화” 2. 전체 프레임워크 논문은 prompt compression을 크게 두 가지로 분류합니다: (1) Hard Prompt Compression (2) Soft Prompt Compression 정리: 구분 방식 특징 Hard token filtering / paraphrasing 해석 가능 Soft embedding /…

-

*** Dynamic Cheatsheet: Test-Time Learning with Adaptive Memory (EACL 2026)

1. 문제 정의 (Motivation) 기존 LLM의 핵심 한계: 논문 핵심 주장: “LLM도 inference 과정에서 지속적으로 학습해야 한다” 즉, 2. 핵심 아이디어: Dynamic Cheatsheet (DC) 직관 LLM에게 “치트시트(cheatsheet)”를 만들어주자: 전체 구조 (핵심 loop) 논문 수식으로 표현: (1) 생성 단계 y~i=Gen(xi,Mi)\tilde{y}_i = Gen(x_i, M_i) (2) 메모리 업데이트 Mi+1=Cur(Mi,xi,y~i)M_{i+1} = Cur(M_i, x_i, \tilde{y}_i) 핵심 특징: 3. DC의 두…

-

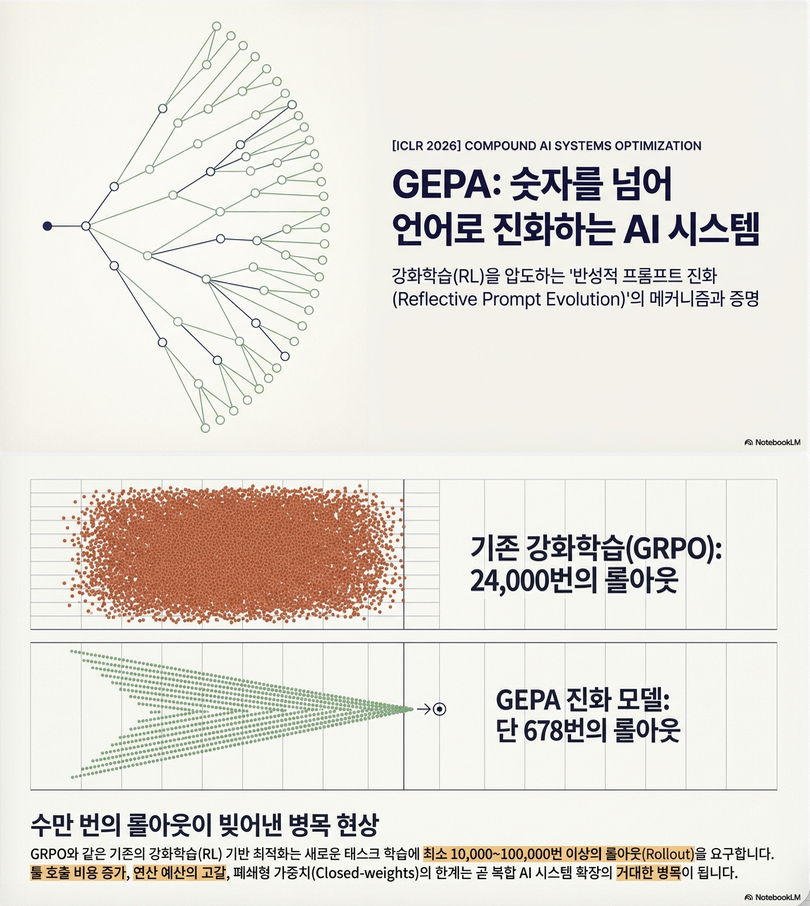

* GEPA: Reflective Prompt Evolution Can Outperform Reinforcement Learning (ICLR 2026)

1. 핵심 아이디어 (Executive Summary) 이 논문은 다음 질문에서 출발합니다: “LLM을 downstream task에 맞게 최적화할 때, RL(예: GRPO)이 정말 최선인가?” 결론: 이를 위해 제안한 방법이: GEPA (Genetic-Pareto Prompt Optimization) 2. 문제 설정 (Problem Formulation) 논문은 LLM 시스템을 다음과 같이 정의합니다: maxΠ,Θ𝔼(x,m)∼Tμ(Φ(x;Π,Θ),m)\max_{\Pi, \Theta} \mathbb{E}_{(x,m)\sim T} \mu(\Phi(x; \Pi, \Theta), m) 핵심 제약: 3. GEPA 방법론 3.1 전체…

-

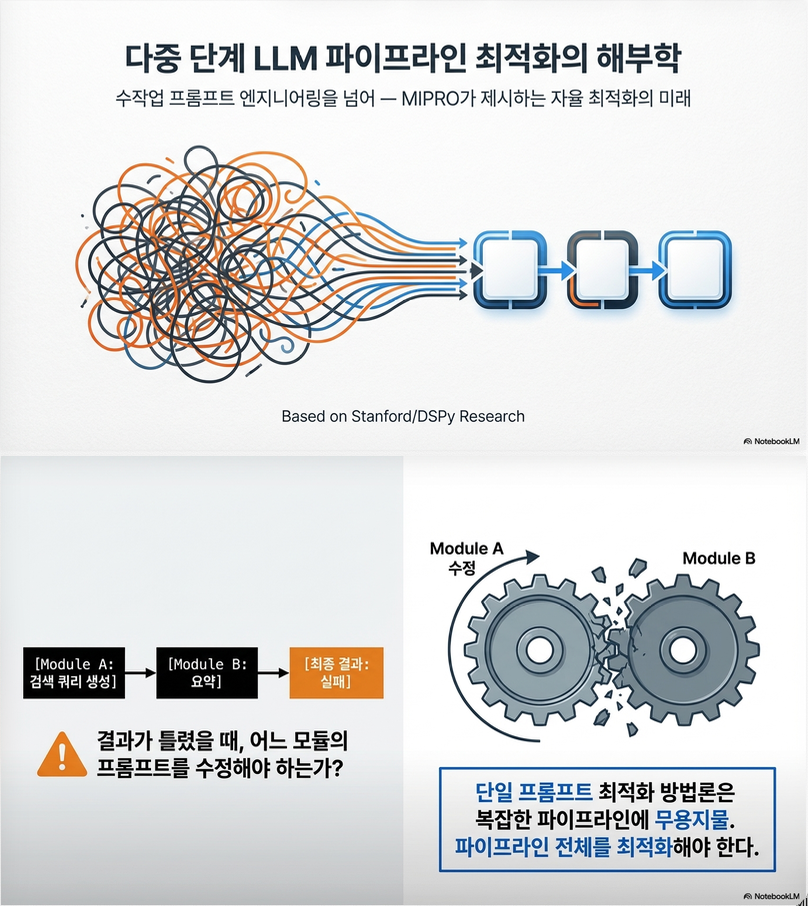

* Optimizing Instructions and Demonstrations for Multi-Stage Language Model Programs (EMNLP 2024)

핵심 질문 여러 단계로 구성된 LM pipeline에서 instruction + few-shot demo를 어떻게 jointly 최적화할 것인가? 1. 문제 설정 (Problem Formulation) LM Program 정의 목표 전체 프로그램 성능을 최대화: Φ∗=argmaxV→S𝔼(x,x′)∼Dμ(ΦV→S(x),x′)\Phi^* = \arg\max_{V \to S} \mathbb{E}_{(x,x’) \sim D} \mu(\Phi_{V \to S}(x), x’) 중요한 점: 즉, credit assignment problem + combinatorial search 2. 핵심 문제 (Challenges) 논문에서 명확히…

-

A Survey of Context Engineering for Large Language Models (ArXiv 2025)

다음 논문은 최근 LLM 연구에서 매우 중요한 흐름인 **“Context Engineering”**을 체계적으로 정리한 대규모 survey입니다. 1. 핵심 개념 (Paper Summary) 이 논문의 핵심 메시지는 다음 한 줄로 요약됩니다: LLM 성능은 “모델 파라미터”보다 “컨텍스트 설계”에 의해 결정된다. 기존: 제안: 2. Context Engineering의 정의 (수식 기반) 논문은 CE를 명확하게 최적화 문제로 formalization 합니다. (1) 기본 LLM 모델 Pθ(Y|C)=∏t=1TPθ(yt|y<t,C)P_\theta(Y|C)…

-

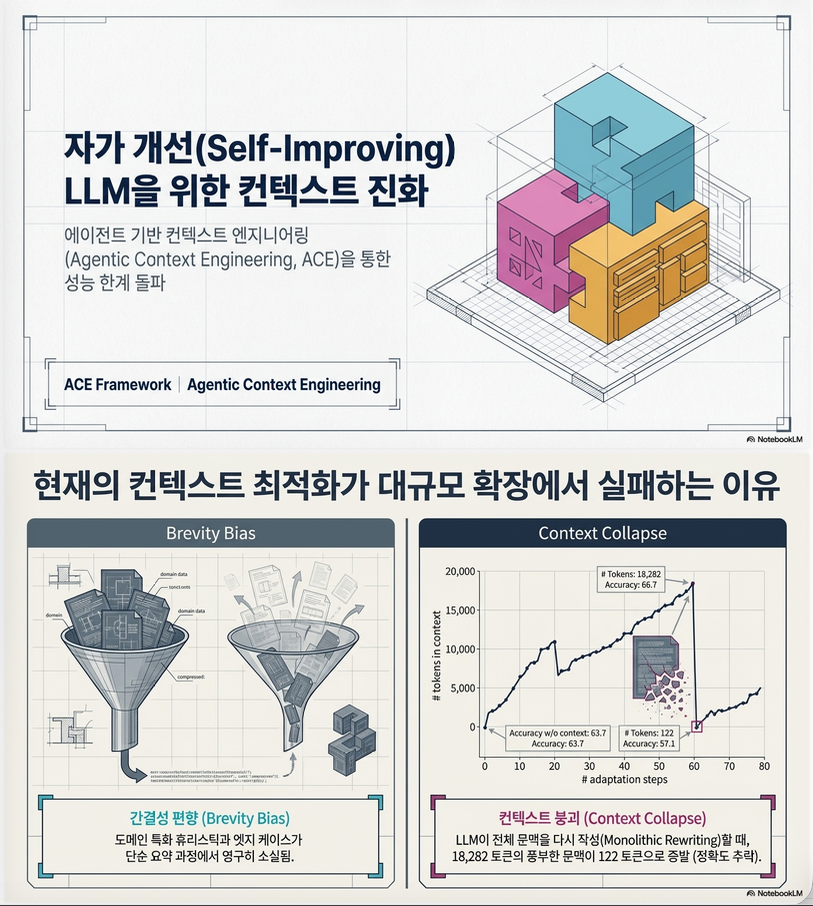

*** Agentic Context Engineering: Evolving Contexts for Self-Improving Language Models (ICLR 2026)

1. 문제 설정: “Context engineering”의 한계 기존 패러다임 LLM 성능 향상 방식: 즉, 최근 트렌드는 “모델을 바꾸지 말고, 입력(context)을 바꿔라” 그러나 기존 방법의 핵심 문제 (1) Brevity Bias (2) Context Collapse 실제 사례: 핵심 insight: “LLM은 summary보다 rich context에서 더 잘 동작한다” 2. 핵심 아이디어: Context = “Evolving Playbook” ACE의 핵심 주장: Context는 “짧은 요약”이…

-

** Searching for Optimal Solutions with LLMs via Bayesian Optimization (ICLR 2025)

1. 문제의식: LLM 기반 “탐색”의 한계 최근 LLM을 테스트 타임에서 여러 번 샘플링하여 더 나은 해를 찾는 방식(test-time compute scaling)이 주목받고 있습니다. 하지만 기존 방식들은 다음 한계를 가집니다: 접근 한계 Repeated Sampling 탐색 공간 구조를 고려하지 않음 Greedy OPRO exploitation 위주 → local optima에 갇힘 진화 알고리즘 비용 큼 / 정적 전략 난이도 예측 기반…

-

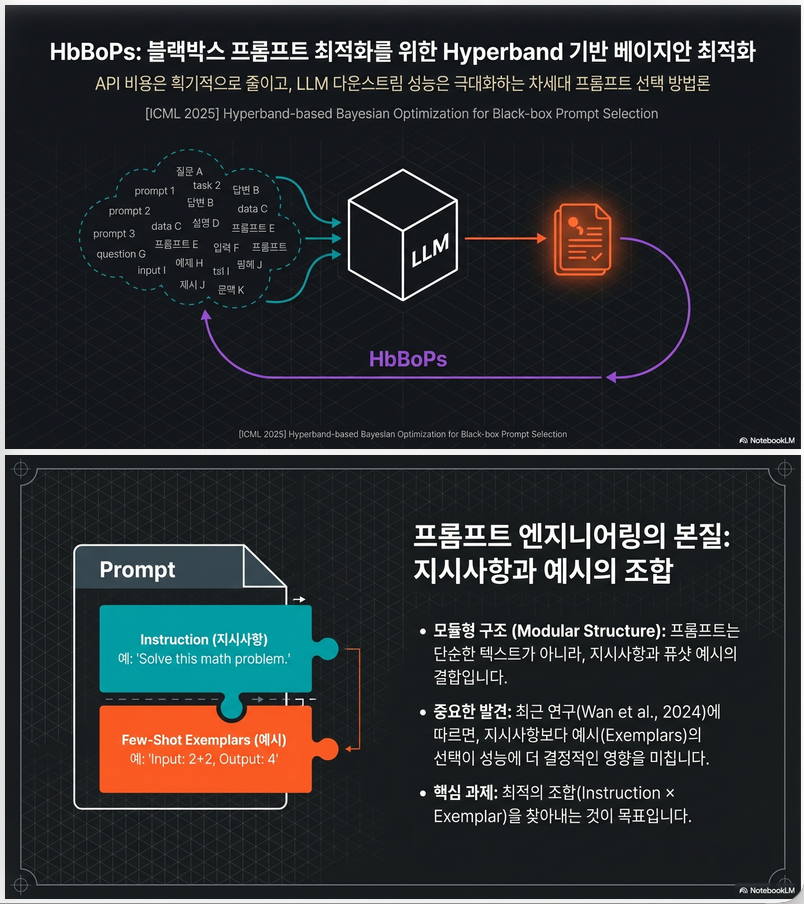

** Hyperband-based Bayesian Optimization for Black-box Prompt Selection (ICML 2025)

1. 문제 설정: Static Black-box Prompt Selection 목표 수식적으로는: argminp∈P𝔼(x,y)[l(y,hp(x))]\arg\min_{p \in P} \mathbb{E}_{(x,y)}[l(y, h_p(x))] 하지만 실제로는 validation set 평균으로 근사: f(p)=1nvalid∑i=1nvalidl(yi,hp(xi))f(p) = \frac{1}{n_{valid}} \sum_{i=1}^{n_{valid}} l(y_i, h_p(x_i)) 여기서 핵심 제약은: 즉, 샘플 효율(sample-efficient) + 쿼리 효율(query-efficient) 이 동시에 필요함. 2. 기존 방법들의 한계 논문에서 지적한 문제점: 방법 한계 EASE exemplar selection 위주, 구조 정보 활용 X…

-

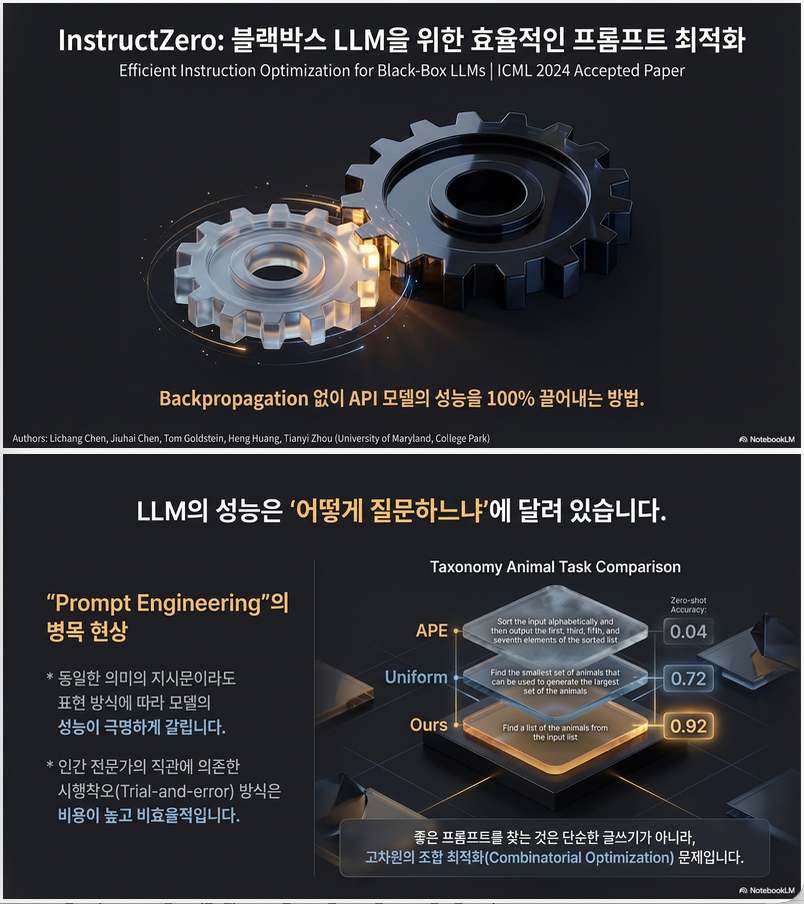

** INSTRUCTZERO: Efficient Instruction Optimization for Black-Box Large Language Models (ICML 2024)

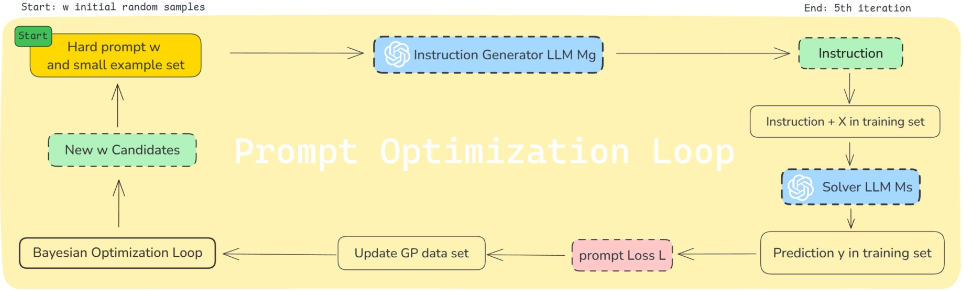

1. 문제 정의: 왜 Instruction 최적화가 어려운가? LLM은 instruction-following 능력이 있지만, instruction phrasing에 매우 민감합니다. 동일한 의미라도 표현이 조금만 달라지면 성능이 크게 변합니다. 논문은 다음 문제를 다룹니다: maxv∈𝒱𝔼(X,Y)∼Dth(f([v;X]),Y)\max_{v \in \mathcal{V}} \mathbb{E}_{(X,Y)\sim D_t} h(f([v;X]), Y) 핵심 난점 2. 핵심 아이디어 직접 instruction을 최적화하지 않는다. 대신, Soft prompt를 최적화해서, open-source LLM이 좋은 instruction을 생성하도록 유도한다. 전체 구조…

-

* Bayesian Optimization for Instruction Generation (BOInG) (Applied Sciences, 2024)

다음 논문은 BO를 이용해 instruction(프롬프트)를 자동 생성하는 방법을 제안한 연구입니다: Sabbatella et al., “Bayesian Optimization for Instruction Generation (BOInG)”, Applied Sciences, 2024 1. 문제 설정: 왜 Instruction을 BO로 최적화하는가? LLM의 성능은 **instruction(=프롬프트)**에 매우 민감합니다. 특히 **black-box LLM (예: GPT-3.5, GPT-4o)**에서는 gradient 접근이 불가능하므로, instruction 최적화는 black-box combinatorial optimization 문제가 됩니다. 논문은 이를 다음과 같이 정식화합니다…