[카테고리:] Agentic AI

-

*** Dynamic Cheatsheet: Test-Time Learning with Adaptive Memory (EACL 2026)

1. 문제 정의 (Motivation) 기존 LLM의 핵심 한계: 논문 핵심 주장: “LLM도 inference 과정에서 지속적으로 학습해야 한다” 즉, 2. 핵심 아이디어: Dynamic Cheatsheet (DC) 직관 LLM에게 “치트시트(cheatsheet)”를 만들어주자: 전체 구조 (핵심 loop) 논문 수식으로 표현: (1) 생성 단계 y~i=Gen(xi,Mi)\tilde{y}_i = Gen(x_i, M_i) (2) 메모리 업데이트 Mi+1=Cur(Mi,xi,y~i)M_{i+1} = Cur(M_i, x_i, \tilde{y}_i) 핵심 특징: 3. DC의 두…

-

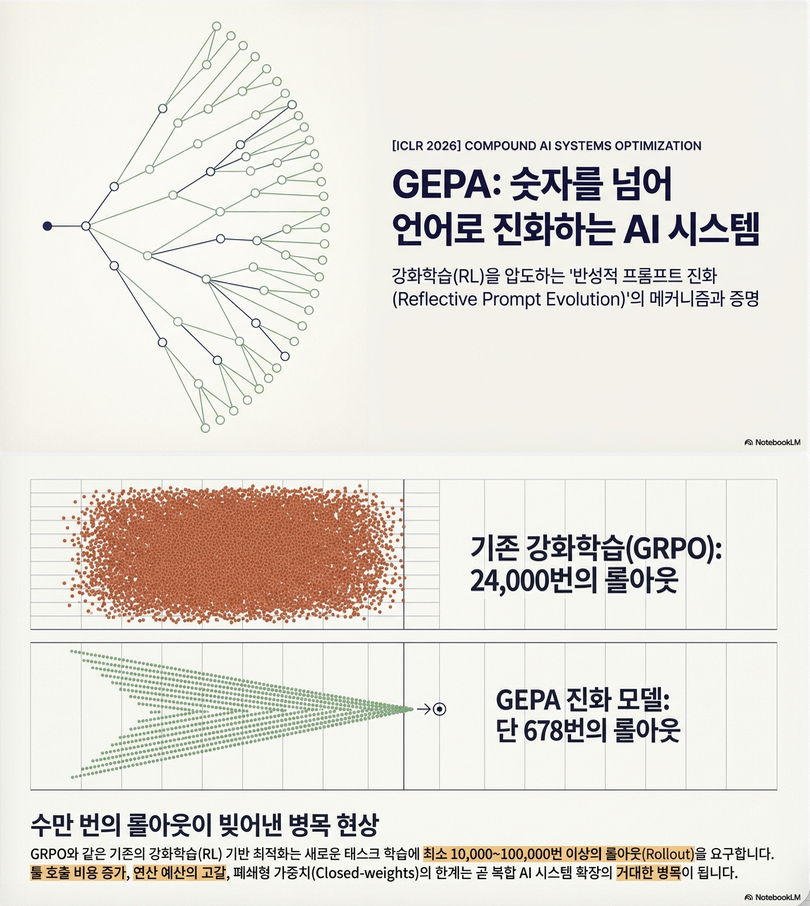

* GEPA: Reflective Prompt Evolution Can Outperform Reinforcement Learning (ICLR 2026)

1. 핵심 아이디어 (Executive Summary) 이 논문은 다음 질문에서 출발합니다: “LLM을 downstream task에 맞게 최적화할 때, RL(예: GRPO)이 정말 최선인가?” 결론: 이를 위해 제안한 방법이: GEPA (Genetic-Pareto Prompt Optimization) 2. 문제 설정 (Problem Formulation) 논문은 LLM 시스템을 다음과 같이 정의합니다: maxΠ,Θ𝔼(x,m)∼Tμ(Φ(x;Π,Θ),m)\max_{\Pi, \Theta} \mathbb{E}_{(x,m)\sim T} \mu(\Phi(x; \Pi, \Theta), m) 핵심 제약: 3. GEPA 방법론 3.1 전체…

-

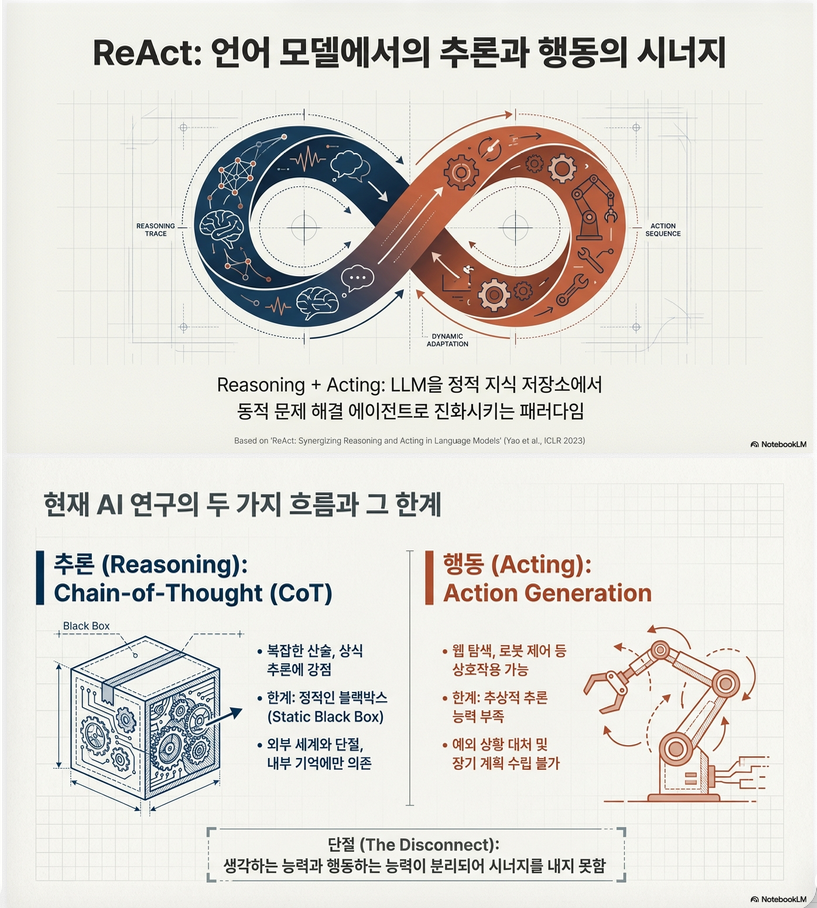

* ReAct: SYNERGIZING REASONING AND ACTING IN LANGUAGE MODELS (ICLR 2023)

1. 핵심 아이디어 (Core Insight) ReAct = Reasoning + Acting의 통합 프레임워크 LLM이 **추론(Thought)**과 **행동(Action)**을 번갈아 수행하도록 만들어 외부 환경과 상호작용하며 문제를 해결하는 방식 핵심 개념: 논문 정의: 2. 방법론 (Methodology) 2.1 ReAct Trajectory 구조 각 step은 다음 3가지로 구성: 예시 (논문 Figure 1): 핵심 특징: 구성 요소 역할 Thought reasoning / 계획 / 상태…

-

A Survey of Context Engineering for Large Language Models (ArXiv 2025)

다음 논문은 최근 LLM 연구에서 매우 중요한 흐름인 **“Context Engineering”**을 체계적으로 정리한 대규모 survey입니다. 1. 핵심 개념 (Paper Summary) 이 논문의 핵심 메시지는 다음 한 줄로 요약됩니다: LLM 성능은 “모델 파라미터”보다 “컨텍스트 설계”에 의해 결정된다. 기존: 제안: 2. Context Engineering의 정의 (수식 기반) 논문은 CE를 명확하게 최적화 문제로 formalization 합니다. (1) 기본 LLM 모델 Pθ(Y|C)=∏t=1TPθ(yt|y<t,C)P_\theta(Y|C)…

-

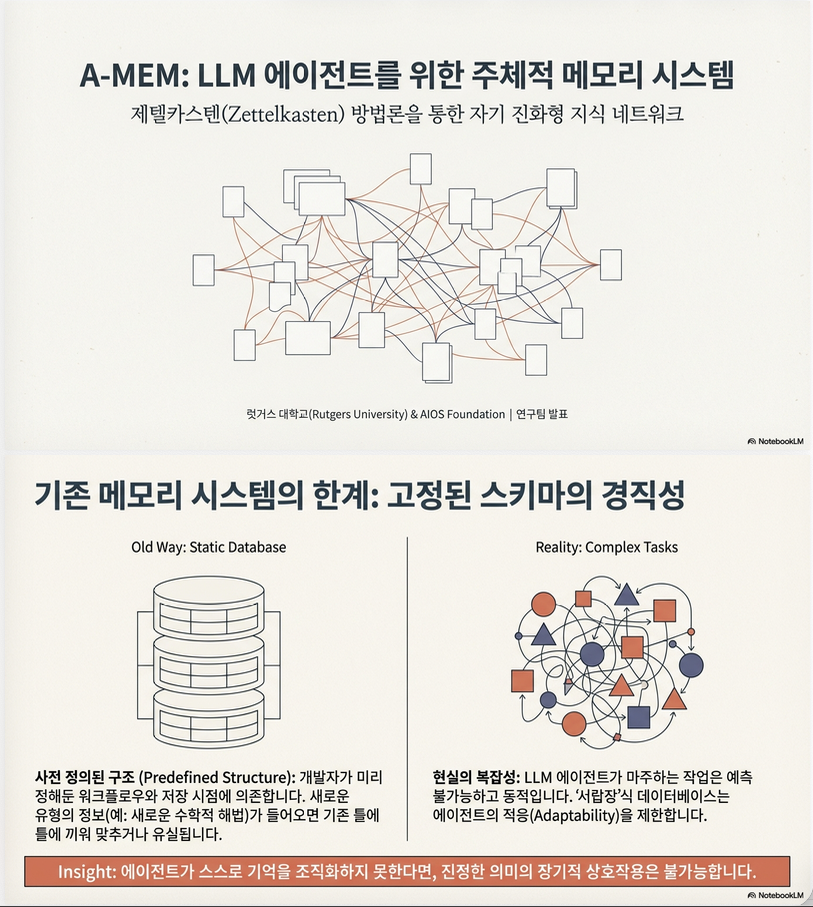

A-MEM: Agentic Memory for LLM Agents (ArXiv 2025)

1. 문제 정의 (Why?) LLM agent는 tool 사용 + reasoning은 강하지만: 기존 memory 시스템의 한계 핵심 문제: “LLM agent가 경험을 통해 지식 구조 자체를 진화시키지 못한다” 2. 핵심 아이디어: Agentic Memory 기존 vs A-MEM 구분 기존 Memory A-MEM 구조 static dynamic link 생성 predefined LLM이 생성 업데이트 없음 memory evolution 역할 storage self-organizing knowledge system…

-

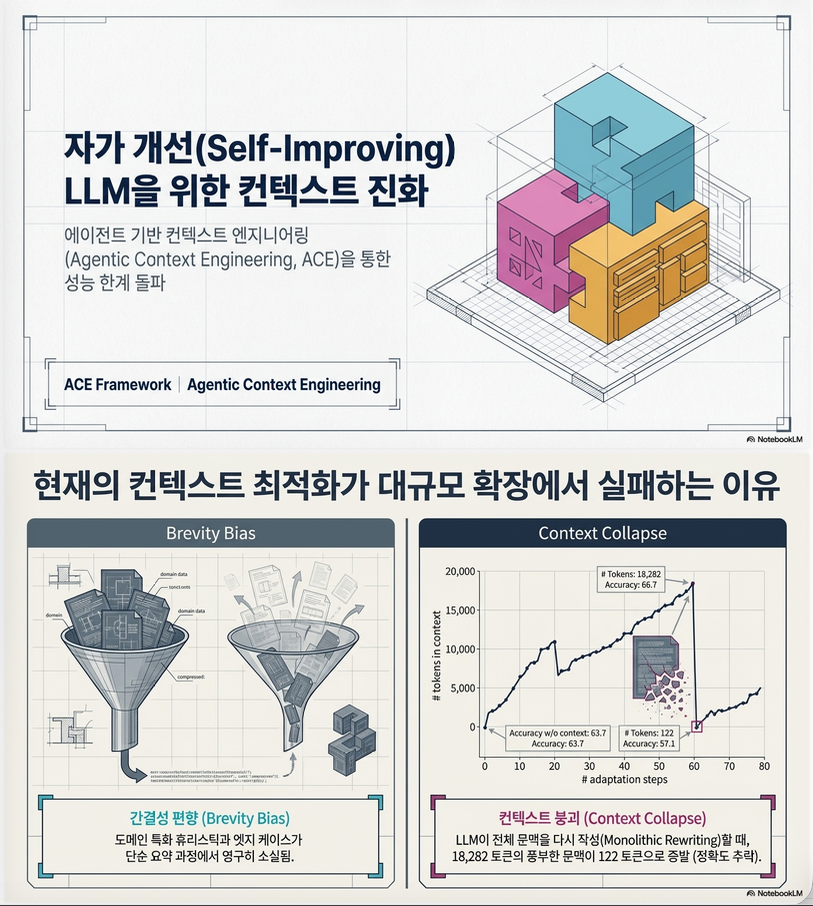

*** Agentic Context Engineering: Evolving Contexts for Self-Improving Language Models (ICLR 2026)

1. 문제 설정: “Context engineering”의 한계 기존 패러다임 LLM 성능 향상 방식: 즉, 최근 트렌드는 “모델을 바꾸지 말고, 입력(context)을 바꿔라” 그러나 기존 방법의 핵심 문제 (1) Brevity Bias (2) Context Collapse 실제 사례: 핵심 insight: “LLM은 summary보다 rich context에서 더 잘 동작한다” 2. 핵심 아이디어: Context = “Evolving Playbook” ACE의 핵심 주장: Context는 “짧은 요약”이…