[카테고리:] mechanistic interpretability

-

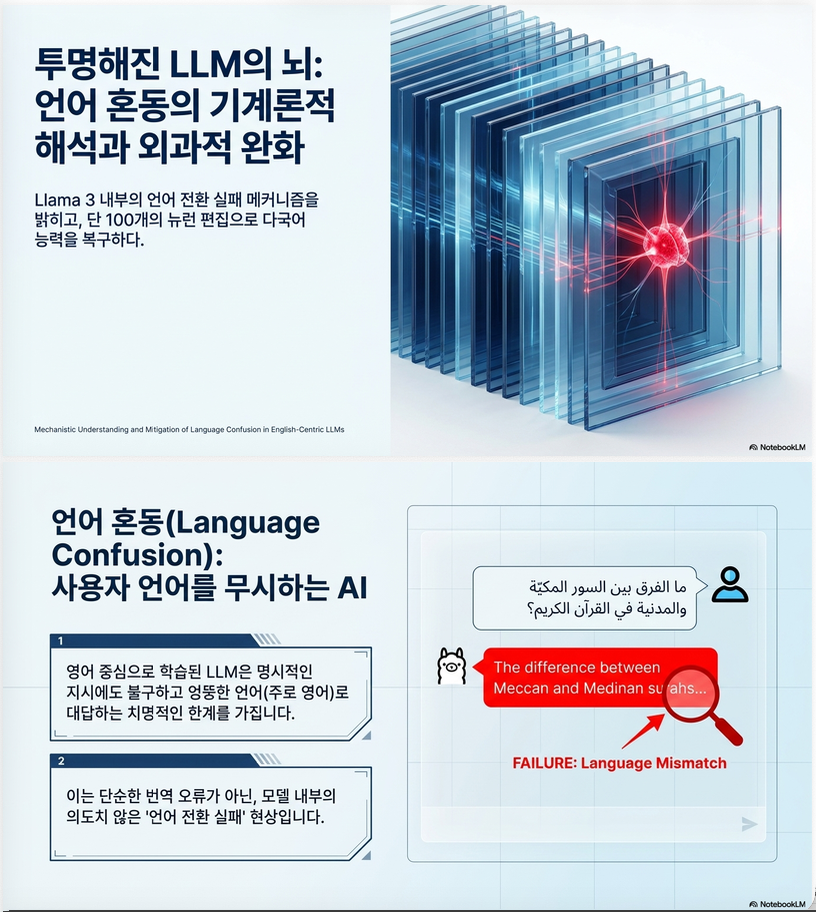

* Mechanistic Understanding and Mitigation of Language Confusion in English-Centric Large Language Models (Findings of EMNLP 2025)

1. 문제 정의: Language Confusion 핵심 현상 유형 예시 (논문 Fig.1): 2. 핵심 개념: Confusion Point (CP) 정의 –> 매우 중요한 insight: 실험 결과 Table 2 (page 4) –> language confusion은 “local failure”임을 보여줌 3. Mechanistic Insight (핵심 기여) 3.1 Layer-wise 분석 (TunedLens 사용) 관찰 (page 5, Fig.2) 결론 language confusion =“latent → surface language…

-

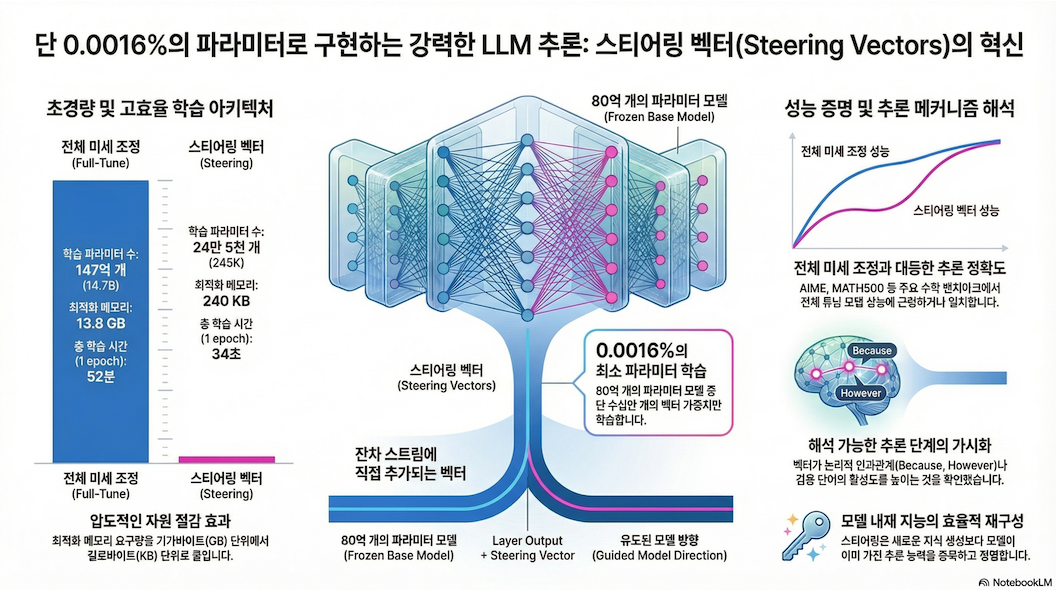

* Steering LLM Reasoning Through Bias-Only Adaptation (ArXiv 2025)

1. 핵심 아이디어 (TL;DR) 이 논문의 핵심은 매우 명확합니다: “LLM의 reasoning 능력은 매우 적은 파라미터 (layer별 vector)만 학습해도 충분히 끌어낼 수 있다.” 즉, reasoning은 “새로 학습되는 능력”이 아니라 이미 존재하는 능력을 특정 방향으로 “증폭(amplify)”하는 것이라는 강한 근거 제공 2. 방법론 (Methodology) 2.1 Steering Vector 정의 각 transformer layer ℓ에 대해: 다음과 같이 단순히 더함: hℓ,t←hℓ,t+sℓh_{\ell,t}…

-

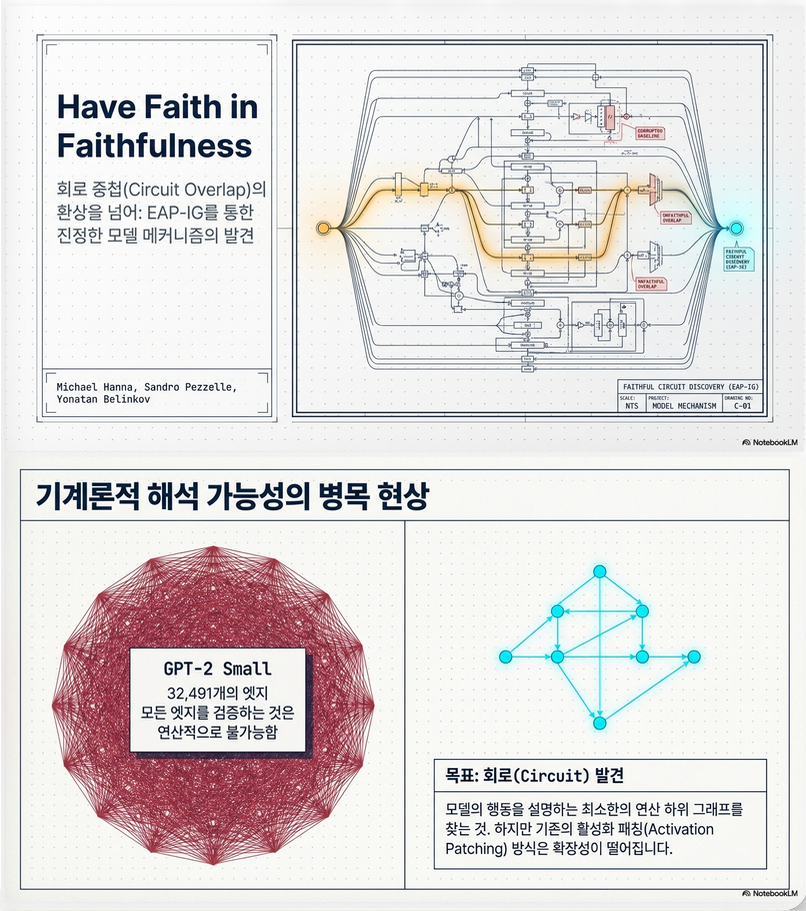

** Have Faith in Faithfulness: Going Beyond Circuit Overlap When Finding Model Mechanisms (COLM 2024)

다음 논문은 **mechanistic interpretability (특히 circuits 분석)**에서 매우 중요한 문제를 짚는 연구입니다: “Have Faith in Faithfulness: Going Beyond Circuit Overlap When Finding Model Mechanisms” (COLM 2024) 1. 핵심 문제의식 (Why this paper matters) 기존 circuit 연구의 암묵적 가정: “찾은 circuit이 ground-truth circuit과 **overlap이 크면 → 잘 찾은 것” 하지만 이 논문은 이를 정면으로 반박합니다: 핵심…

-

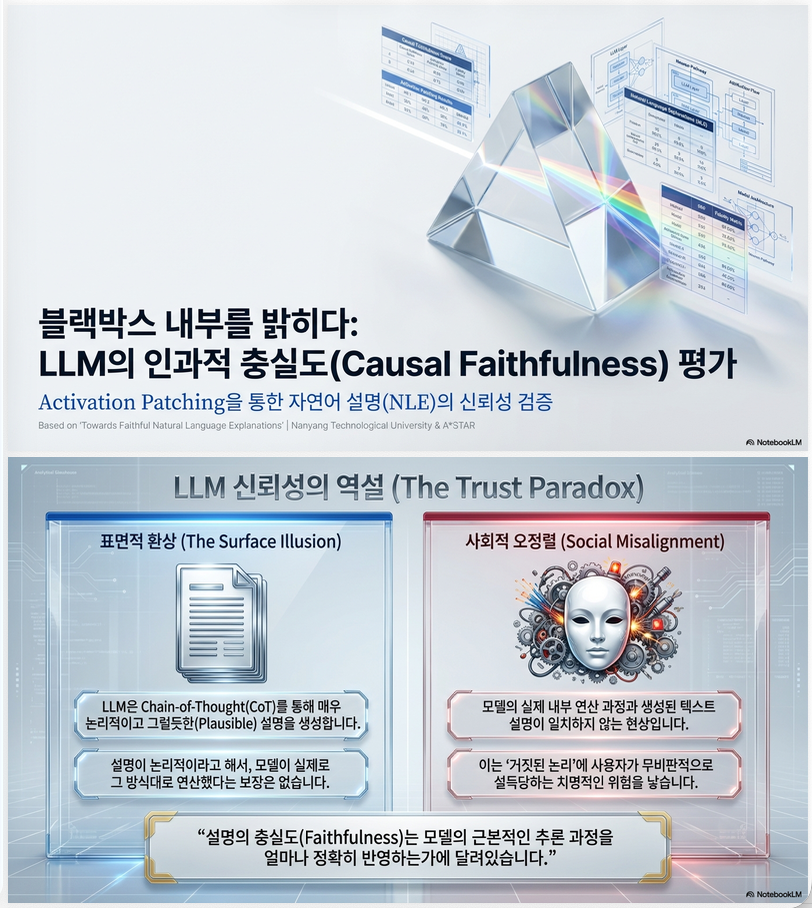

* Towards Faithful Natural Language Explanations: A Study Using Activation Patching in LLMs (EMNLP 2025)

다음 논문은 LLM의 Natural Language Explanation (NLE)의 “faithfulness(충실성)”을 내부 causal 관점에서 측정하는 매우 중요한 메커니즘 기반 연구입니다 1. 핵심 문제 정의 문제 LLM은 CoT 등으로 **그럴듯한 설명(plausible explanation)**을 잘 생성하지만, 이 설명이 실제 내부 reasoning을 반영하는지 (faithful) 는 별개 즉, Faithfulness 정의 논문은 다음 정의를 채택: “Explanation이 모델의 실제 reasoning process를 얼마나 정확히 반영하는가” 즉,…

-

** Can LLMs Predict Their Own Failures? Self-Awareness via Internal Circuits (ArXiv 2025)

이 논문은 “LLM이 자신의 답이 틀렸다는 것을 스스로 예측할 수 있는가?”라는 질문을 다룹니다. 핵심 아이디어는 텍스트나 외부 judge 모델이 아니라 LLM 내부 activation(숨겨진 상태와 attention)에서 직접 오류 신호를 읽어내는 것입니다. 아래에서 연구 문제 → 핵심 아이디어 → 방법론(Gnosis) → 실험 결과 → 연구적 의미 순서로 정리합니다. 1. 연구 문제 (Problem) LLM의 대표적인 문제: 하지만 LLM은…

-

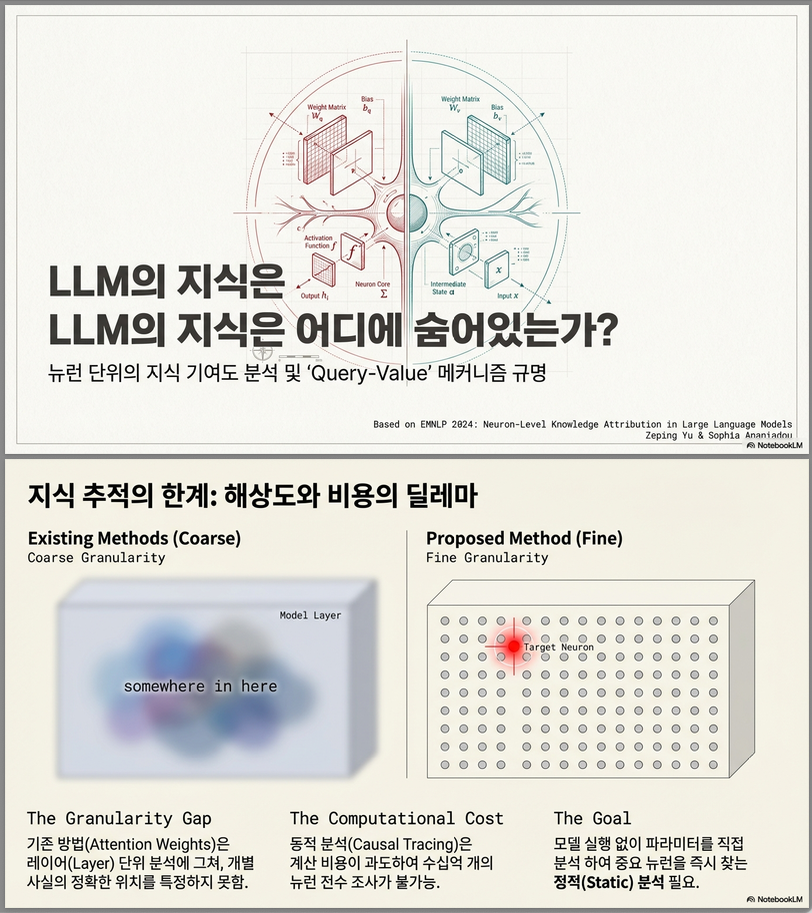

** Neuron-Level Knowledge Attribution in Large Language Models (EMNLP 2024)

아래는 EMNLP 2024 논문 “Neuron-Level Knowledge Attribution in Large Language Models” 의 핵심 내용을 정리한 설명입니다. 논문 개요 이 논문은 LLM 내부에서 특정 지식(facts)이 어떤 뉴런(neuron)에 저장되는지 정량적으로 찾아내는 뉴런 수준(neuron-level) attribution 방법을 제안합니다. 피쳐 단위(head, layer)보다 더 미세한 수준입니다. 기존 기법은 논문은 이를 해결하기 위해: 을 수행합니다. 배경 (왜 뉴런 수준인가?) 이전 연구들(Geva et…

-

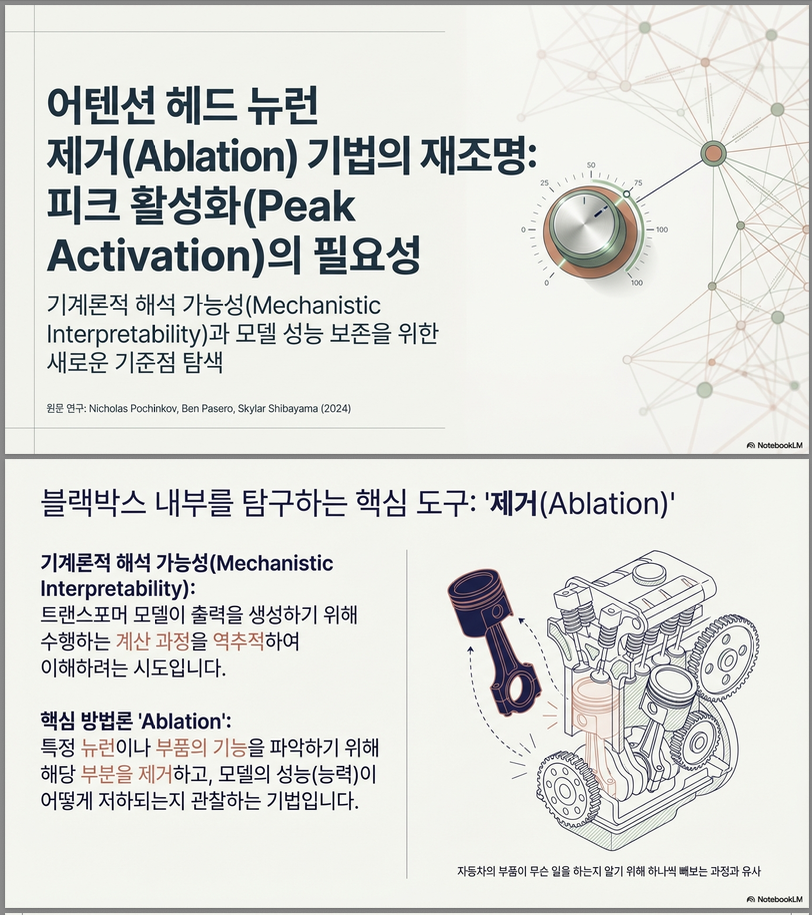

* Investigating Neuron Ablation in Attention Heads: The Case for Peak Activation Centering (ArXiv 2024)

논문 “Investigating Neuron Ablation in Attention Heads: The Case for Peak Activation Centering” (Pochinkov et al., 2024) 은 Transformer 기반 모델의 주의(attention) 뉴런 해석과 절제(ablation) 방법을 체계적으로 비교하고, 새로운 방식인 **Peak Ablation (정점 중심 절제)**을 제안한 연구입니다. 아래에 핵심 내용을 구조적으로 정리했습니다. 1. 연구 배경 및 문제의식 기존 절제 방식: 2. 제안 개념: Peak Ablation…

-

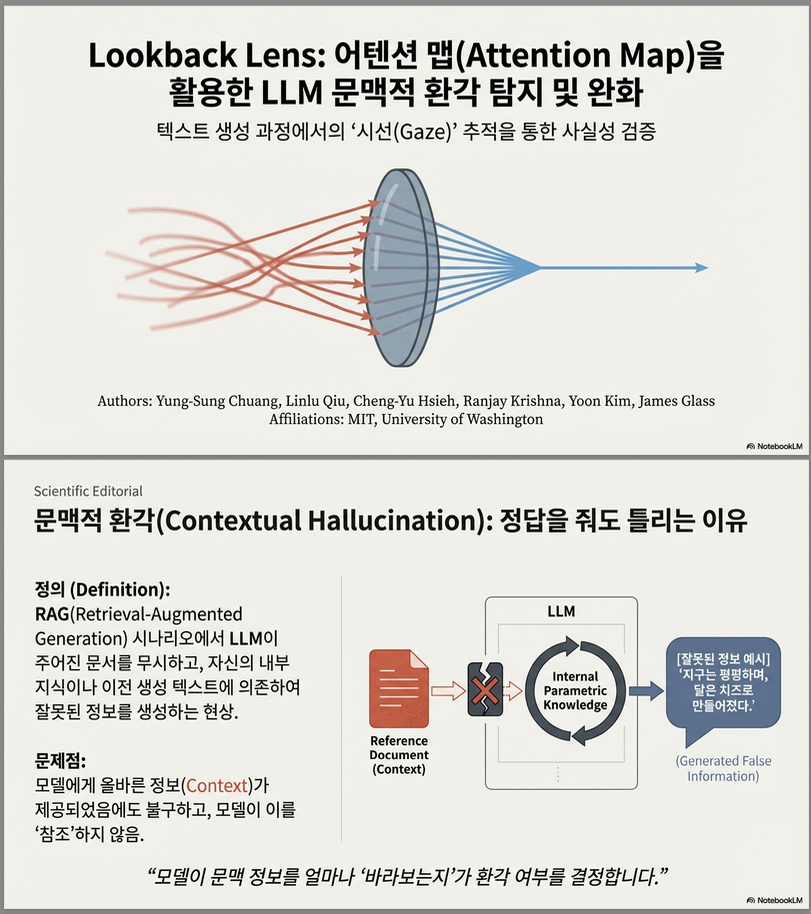

*** Lookback Lens: Detecting and Mitigating Contextual Hallucinations in Large Language Models Using Only Attention Maps (EMNLP 2024)

다음 논문은 “Lookback Lens: Detecting and Mitigating Contextual Hallucinations in Large Language Models Using Only Attention Maps” (EMNLP 2024) 입니다 . 이 논문은 **LLM의 contextual hallucination(문맥 기반 환각)**을 attention map만을 사용해 탐지하고, decoding 단계에서 이를 완화하는 방법을 제안합니다. 1. 문제 정의: Contextual Hallucination 논문은 환각을 두 종류로 구분합니다: 이 논문은 **후자(context-grounded setting)**에 집중합니다. 대표 예:…

-

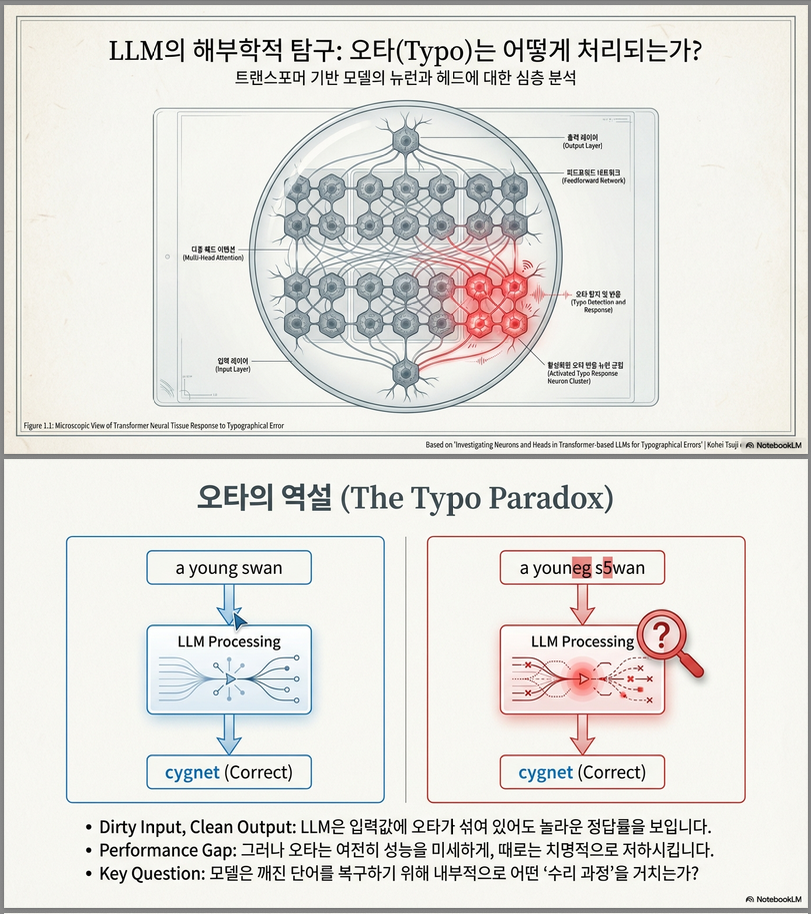

*** Investigating Neurons and Heads in Transformer-based LLMs for Typographical Errors (EMNLP 2025)

다음은 **EMNLP 2025 논문 “Investigating Neurons and Heads in Transformer-based LLMs for Typographical Errors”**에 대한 핵심 정리입니다. 연구 동기 LLM 입력에는 종종 **오타(typo)**가 포함되며, 모델은 때때로 이를 내부적으로 보정해 올바른 의미를 복원합니다. 그러나 경우에 따라 오타는 모델의 성능 저하를 유발합니다. 이 연구는: 어떤 뉴런(neurons)과 어떤 어텐션 헤드(attention heads)가 오타를 감지·보정하는지 밝혀내는 것이 목표입니다. 주요 연구…

-

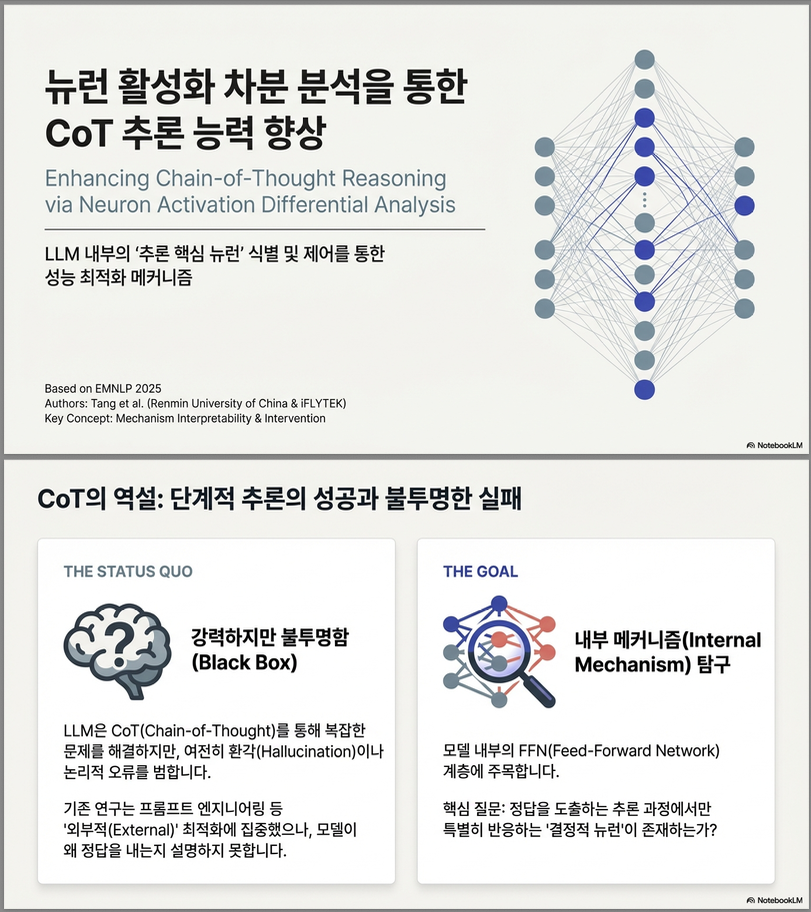

*** Enhancing Chain-of-Thought Reasoning via Neuron Activation Differential Analysis (EMNLP 2025)

논문 “Enhancing Chain-of-Thought Reasoning via Neuron Activation Differential Analysis” (EMNLP 2025) 은 LLM의 연쇄적 사고(Chain-of-Thought, CoT) 능력을 뉴런 수준에서 해석하고 향상시키는 방법을 제안한 연구입니다. 아래는 핵심 내용을 정리한 설명입니다. 연구 배경 제안 방법 1. 대비 데이터셋(Contrastive Dataset) 구축 2. 뉴런 활성도 차이 계산 3. 핵심(reasoning-critical) 뉴런 선택 4. 뉴런 개입(Intervention) 주요 결과 모델 평균 성능…

-

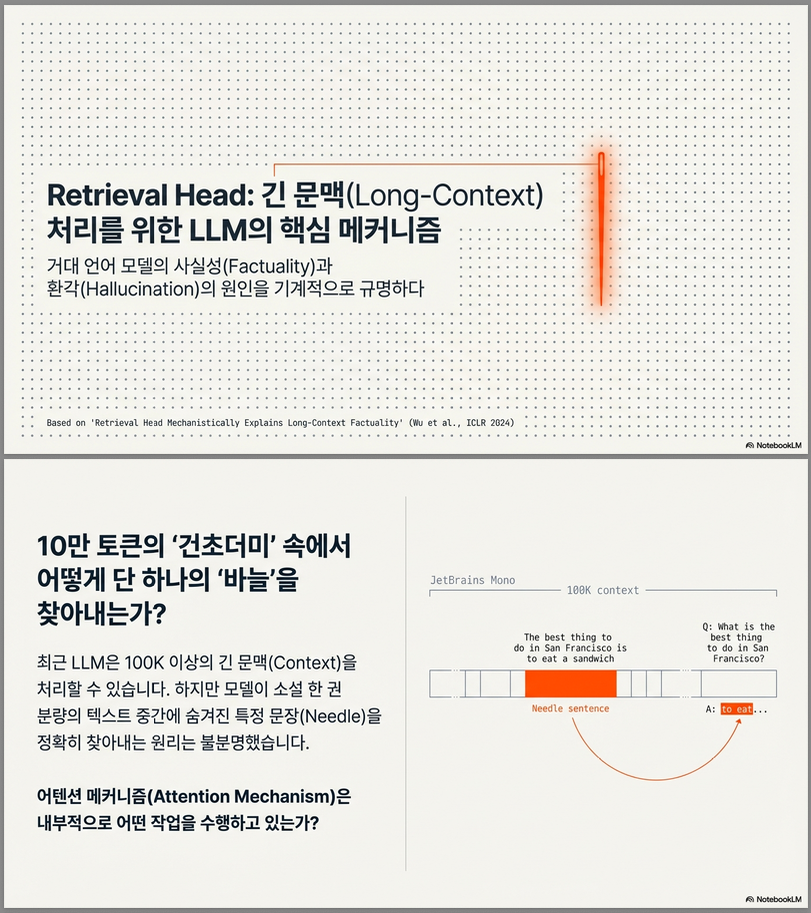

** Retrieval Head Mechanistically Explains Long-Context Factuality (ICLR 2024)

아래는 「Retrieval Head Mechanistically Explains Long-Context Factuality」(ICLR 2024) 논문의 핵심을 문제의식 → 방법론 → 주요 발견 → 실험적 근거 → 시사점 순서로 정리한 설명입니다. 1. 문제의식 장문 컨텍스트(수만~십만 토큰)에서 LLM이 어떻게 필요한 정보를 정확히 찾아(faithful retrieval) 출력하는지 내부 메커니즘은 불분명했다. 특히 Needle-in-a-Haystack 유형에서 사실성이 유지되는 이유를 어떤 내부 구성요소가 담당하는가가 핵심 질문이다. 2. 핵심 가설…

-

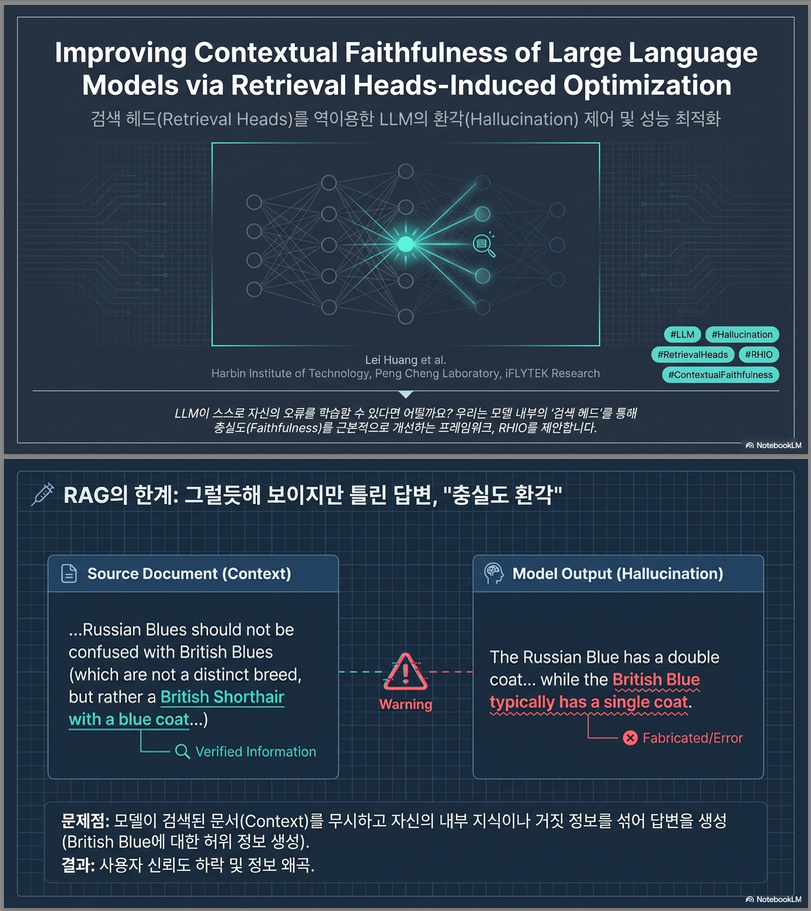

*** Improving Contextual Faithfulness of Large Language Models via Retrieval Heads-Induced Optimization (ACL 2025)

논문 “Improving Contextual Faithfulness of Large Language Models via Retrieval Heads-Induced Optimization” (ACL 2025 Long Paper) 은 RAG 기반 LLM의 신뢰도 문제, 특히 문맥적 정합성(contextual faithfulness) 을 향상시키는 새로운 방법을 제안한 연구입니다 . 1. 연구 배경 2. 주요 아이디어: RHIO 프레임워크 RHIO = Retrieval Heads-Induced Optimization “retrieval head를 마스킹하여 비충실(unfaithful)한 샘플을 인위적으로 만들고, 이를 이용해…

-

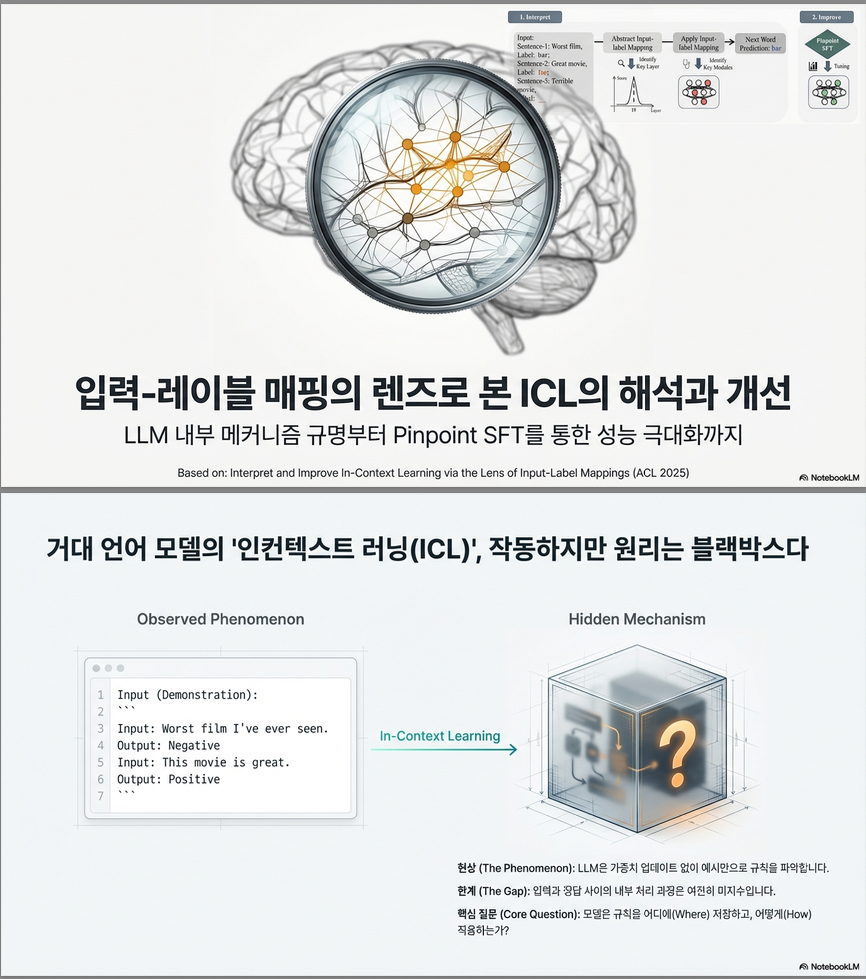

*** Interpret and Improve In-Context Learning via the Lens of Input-Label Mappings (ACL 2025)

논문 **“Interpret and Improve In-Context Learning via the Lens of Input-Label Mappings” (ACL 2025)**는 대형 언어 모델(LLM)의 In-Context Learning (ICL) 능력을 **입력-레이블 매핑(input-label mappings)**의 관점에서 분석하고, 해당 메커니즘을 해석하며, 향상시키는 방법을 제안합니다. 1. 연구 질문 LLM의 ICL 성능을 분석하기 위해 다음 세 가지 질문을 다룹니다: 2. 주요 기여 (1) 입력-레이블 매핑의 발견 (2) PC Patching 기법 (3) 매핑…

-

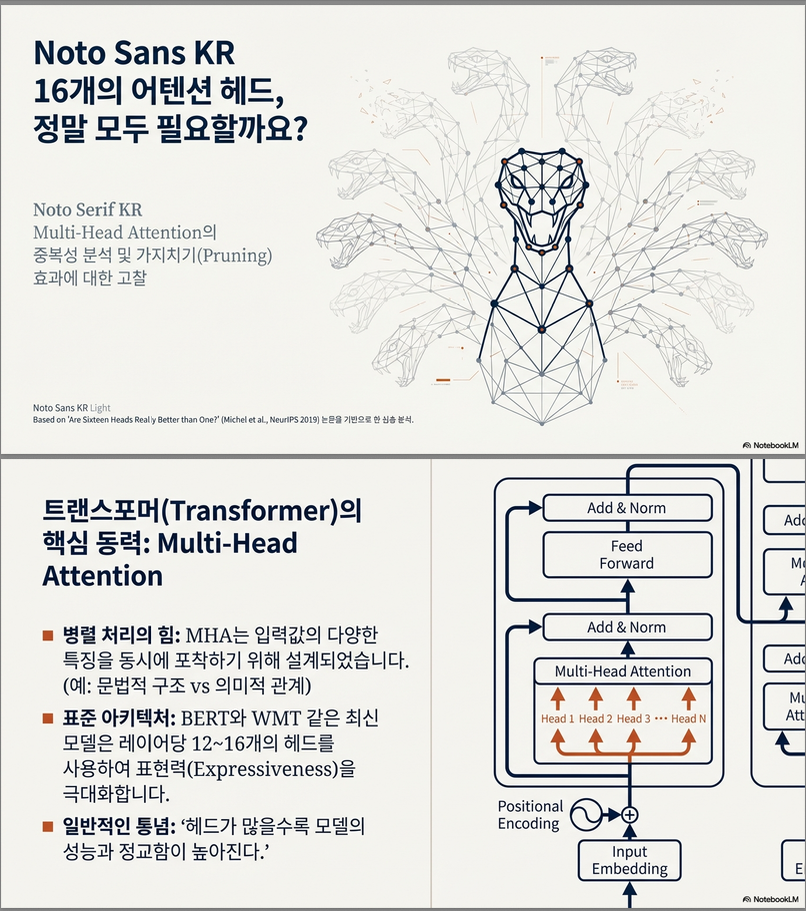

* Are Sixteen Heads Really Better than One? (NeurIPS 2019)

이 논문은 **Transformer의 multi-head attention(MHA)가 정말로 많은 head를 필요로 하는가?**라는 매우 직관적인 질문을 실증적으로 파고든 고전적인 분석 논문입니다. 아래에서 문제의식 → 방법론 → 실험 결과 → 핵심 해석 → 이후 연구에 미친 영향 순서로 정리해 드릴게요. (논문: Are Sixteen Heads Really Better than One?, NeurIPS 2019) 1. 문제의식 (Motivation) Transformer에서 multi-head attention은 다음과 같은 이유로…

-

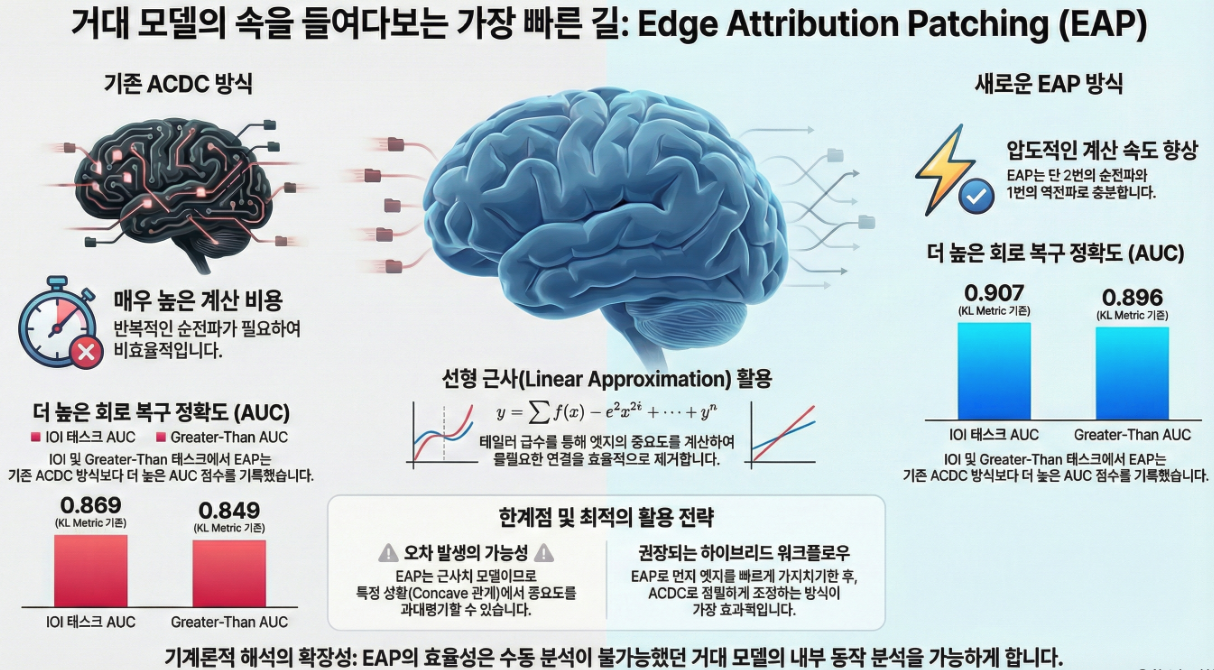

*** Attribution Patching Outperforms Automated Circuit Discovery (BlackboxNLP 2024)

아래는 **BlackboxNLP 2024 논문 〈Attribution Patching Outperforms Automated Circuit Discovery〉**의 핵심 내용을 구조적으로 정리한 상세 설명입니다. 1. 논문의 문제의식 (Introduction) 메커니스틱 인터프리터빌리티의 핵심 목표는 LLM 내부에서 특정 작업(Task)을 수행하는 서브네트워크(circuit)를 자동으로 찾아내는 것이다. 기존 자동화된 방법의 대표는 **ACDC (Automated Circuit Discovery)**로, 각 *edge(노드 간의 activation flow)*가 해당 작업에 얼마나 기여하는지 activation patching을 반복적으로 수행해 측정한다.…

-

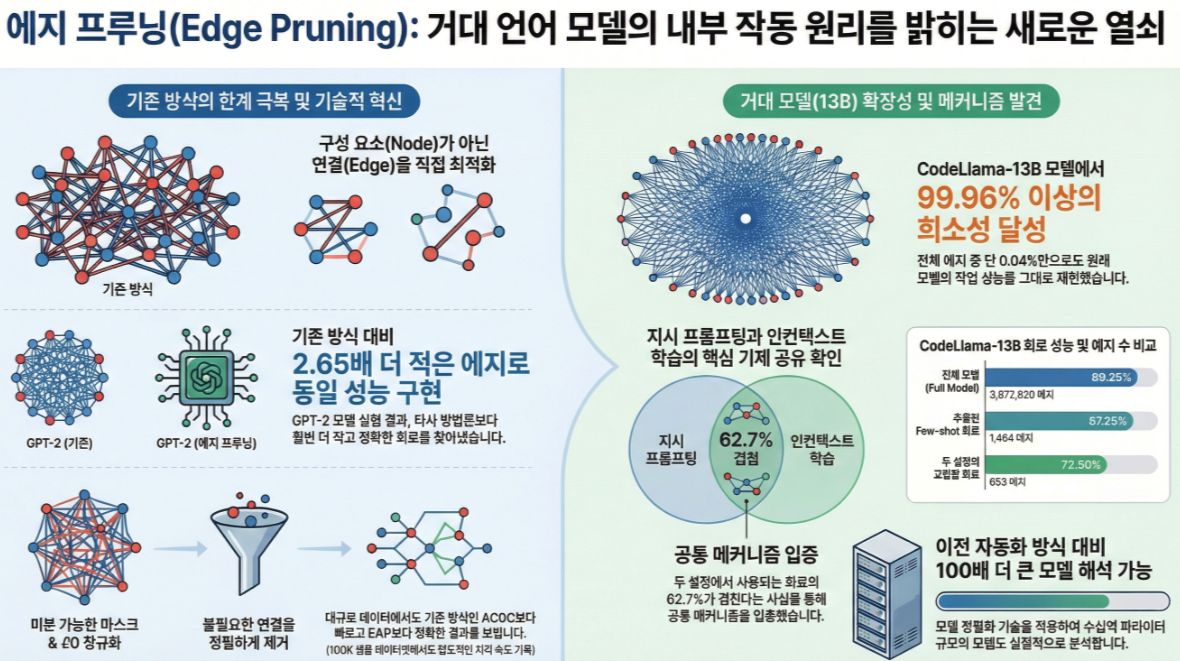

*** Finding Transformer Circuits with Edge Pruning (NeurIPS 2024)

아래는 논문 **“Finding Transformer Circuits with Edge Pruning (NeurIPS 2024)”**의 핵심 내용을 직관적으로, 기존 ACDC/EAP과의 차이를 중심으로, 수식·개념까지 포함해 정리한 설명입니다. 🔍 1. 연구 배경: 왜 Edge Pruning인가? Transformer의 동작을 해석하려면 모델 내부에서 특정 기능을 수행하는 회로(circuit) 를 찾아야 한다. 기존 자동 회로 추출 방식에는 두 가지 대표적 접근이 있다: (1) ACDC (2023) (2) EAP…

-

*** Knowledge Circuits in Pretrained Transformers (NeurIPS 2024)

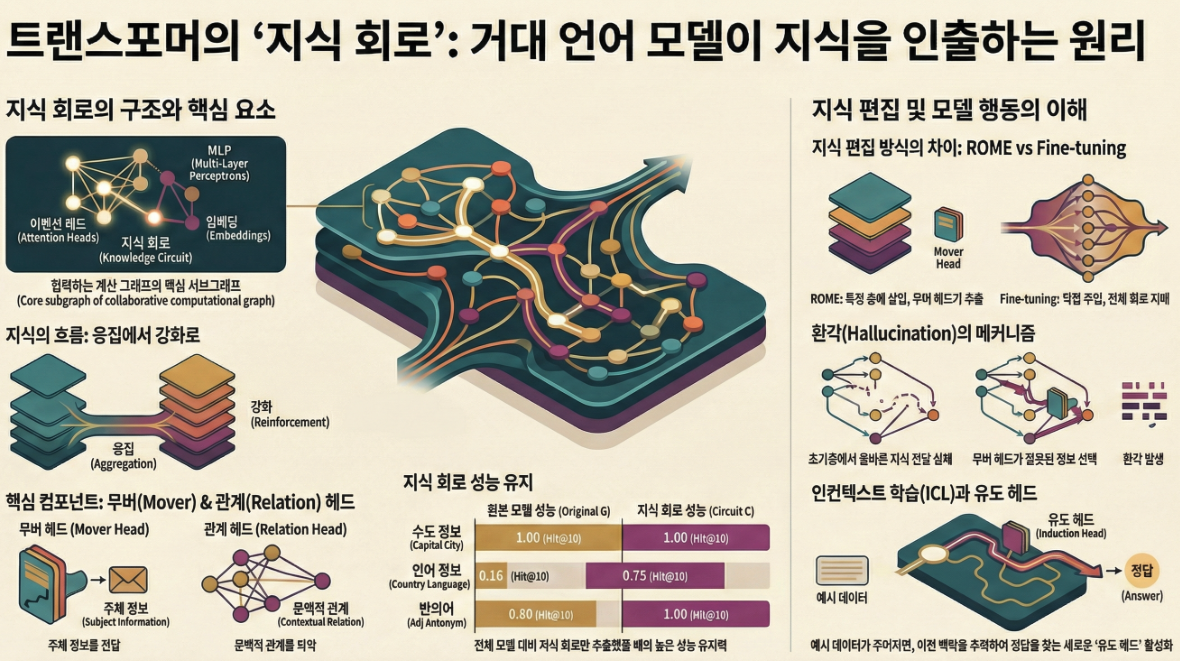

다음은 NeurIPS 2024에 발표된 “Knowledge Circuits in Pretrained Transformers” 논문의 주요 내용 요약입니다. 이 논문은 LLM 내부의 지식 저장 메커니즘을 **회로(circuit)**의 관점에서 새롭게 분석한 연구입니다. 1. 연구 배경 2. Knowledge Circuit의 정의 3. 연구 방법론 (1) Knowledge Circuit 탐색 (2) 모델 및 데이터 4. 주요 실험 결과 (1) Knowledge Circuit의 성능 Knowledge Type Original (Hit@10)…

-

*** Towards Automated Circuit Discovery for Mechanistic Interpretability (NeurIPS 2023)

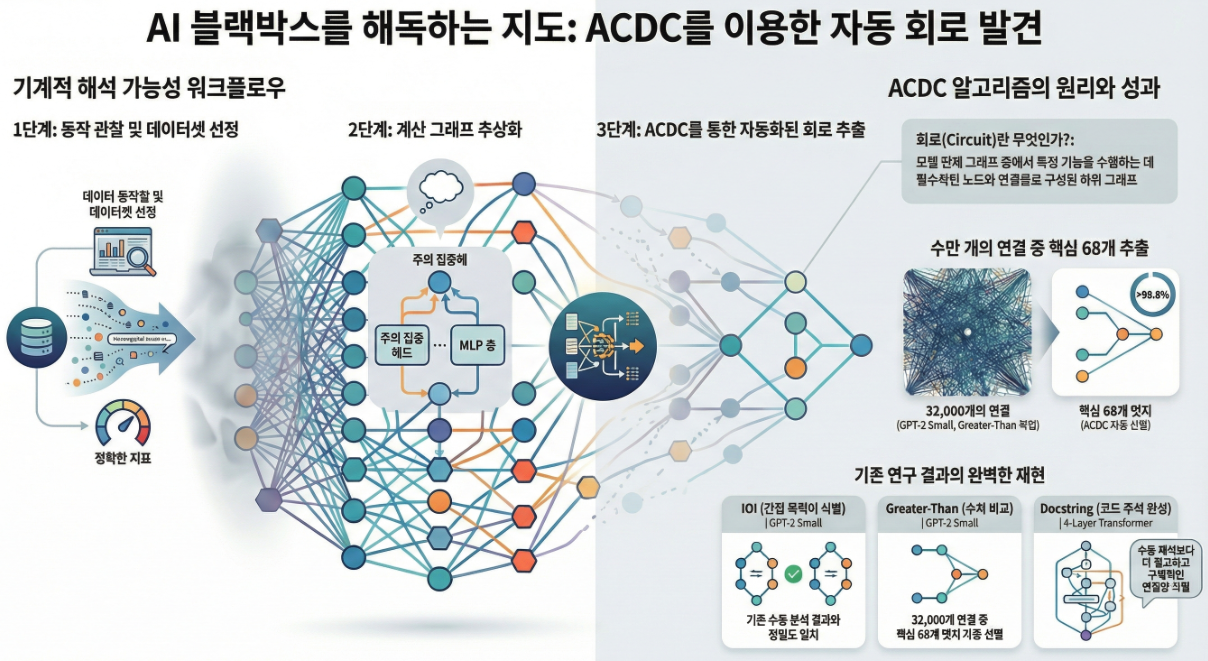

아래는 **“Towards Automated Circuit Discovery for Mechanistic Interpretability (NeurIPS 2023)”**의 핵심 내용을 정리한 설명입니다. 논문의 목적 Transformer 기반 LLM은 뛰어난 성능에도 불구하고 내부 동작이 블랙박스처럼 보입니다. 메커니스틱 인터프리터빌리티 연구는 내부 컴포넌트(Attention Head, MLP 등)가 구체적으로 어떤 알고리즘을 수행하는지 밝히려고 하지만, 현재는 사람이 일일이 수작업으로 분석하는 방식이라 확장성이 떨어집니다. 이 논문은 그 과정을 체계화하고 특히 회로(circuit)를…

-

** LogitLens4LLMs: Extending Logit Lens Analysis to Modern Large Language Models (ArXiv 2025)

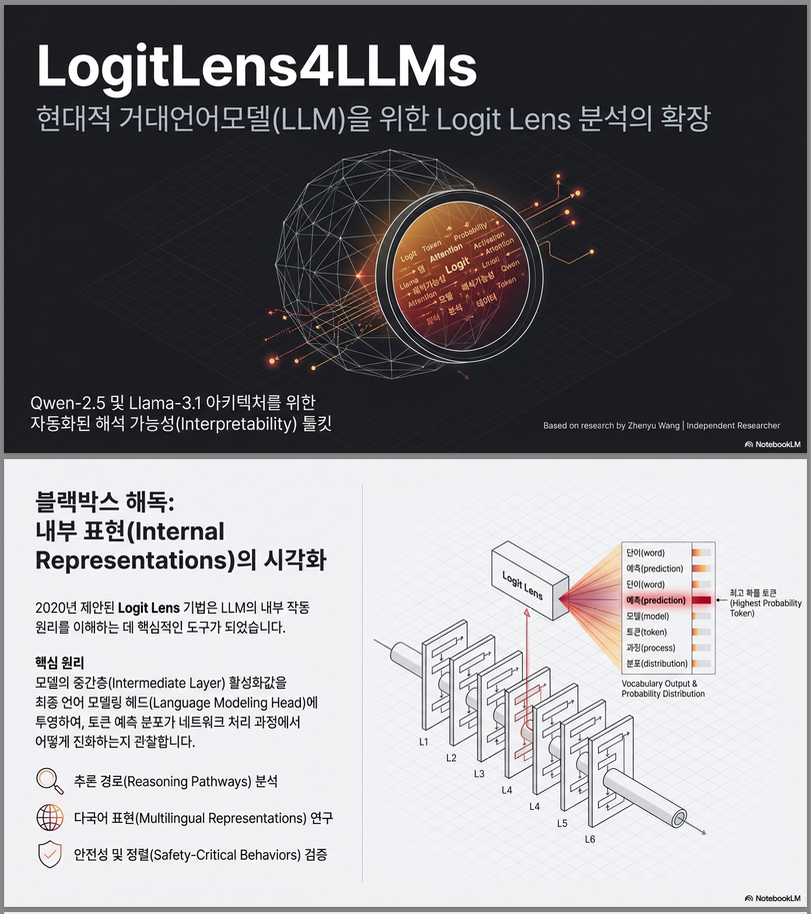

아래는 **arXiv 2025 논문 *“LogitLens4LLMs: Extending Logit Lens Analysis to Modern Large Language Models”***에 대한 설명입니다. 설명은 배경 → 방법론 → 시스템 설계 → 시각화 및 결과 → 기여와 한계 순으로 정리했습니다. 1. 연구 배경과 문제의식 Logit Lens는 중간 layer의 hidden state를 최종 LM head로 바로 투사하여, “이 layer에서 이미 어떤 토큰을 예측하고 있는가?”를 관찰하는 대표적인 mechanistic interpretability 기법입니다.…