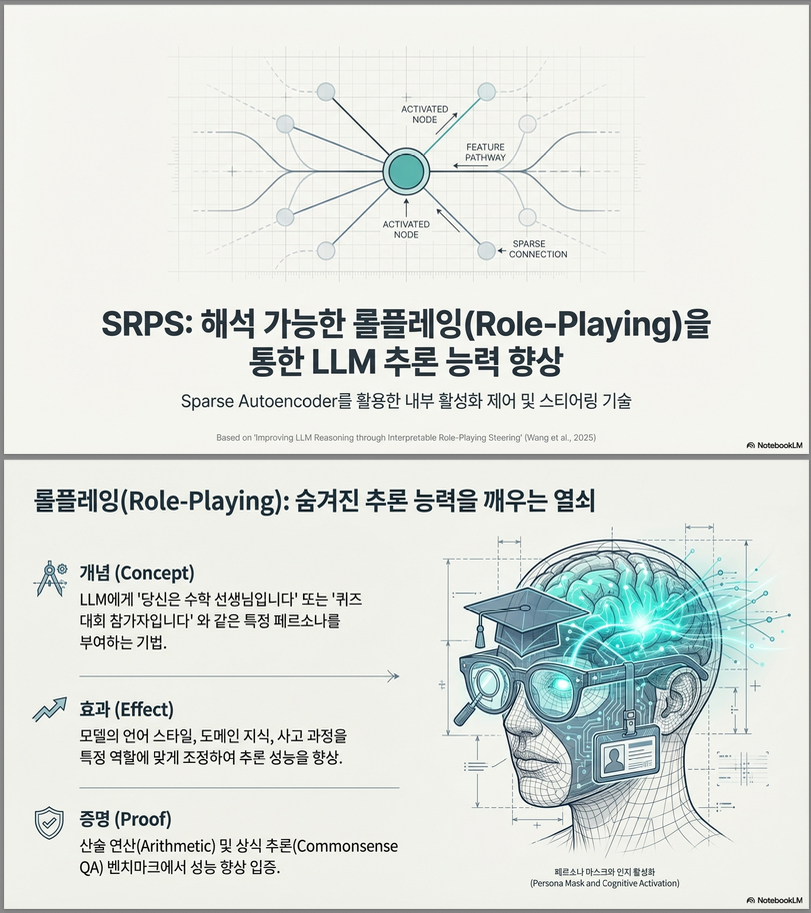

논문 “Improving LLM Reasoning through Interpretable Role-Playing Steering” (Findings of EMNLP 2025) 은 역할 수행(role-playing) 기반 추론 강화 기법을 LLM 내부 표현 수준에서 해석 가능하게 제어하는 새로운 접근법을 제안합니다. 핵심은 Sparse Autoencoder(SAE) 로 모델 내부 활성화 패턴을 분석하고, 역할 수행 시 활성화되는 잠재 특징(latent features)을 추출하여 Residual Stream에 주입(steering) 함으로써 모델의 “역할 일관적(reasoning-consistent)” 사고를 유도하는 것입니다 .

1. 연구 동기

- 문제점: 기존 역할 수행(Role-play) 프롬프트는 입력 수준에 의존해

- (1) 작은 문장·구두점 변화에도 불안정,

- (2) 내부 작동 해석이 불가능,

- (3) zero-shot CoT(Chain-of-Thought)에만 검증되는 한계가 있습니다 .

- 목표: 내부 표현 조작을 통해 역할 수행 효과를 안정적·정량적으로 재현하고, 그 과정을 해석 가능하게(interpretability) 만드는 것.

2. 제안 기법: SRPS (Sparse Autoencoder Role-Playing Steering)

(1) 구조 개요

두 입력을 비교:

r⁺ = role-play prompt 포함 / r⁻ = 미포함

SAE로 latent activation 추출 → Top-K 특징 선택 → steering vector s 구성 → residual stream에 주입 .

(2) 세부 단계

a. Role-Play Activation 추출

- 각 데이터에 대해 (r⁺, r⁻) 쌍 N개 구성.

- SAE를 통해 residual stream의 latent activation 획득.

- 문장 전체 평균 활성화 계산 시 BOS·구두점·stopword 제외하여 의미 없는 패턴 배제 .

b. Role-Relevant Feature 선택

- SAE feature i의 평균 활성화 차이:

- 활성화 빈도 차이:

- 민감도 점수(sensitivity): → 상위 k개의 feature 선택 .

c. Steering Vector 구성

- SAE 디코더 행렬 의 선택된 행들을 사용: (αᵢ는 role-play 시 평균 활성화값, vᵢ는 디코더 벡터)

- 모델 residual stream에 주입: , (λ은 steering 강도 조절 계수) .

3. 실험 결과

모델 및 데이터셋

- 모델: Llama 3.1-8B, Gemma 2-2B, Gemma 2-9B

- 데이터: GSM8K, SVAMP (수학적 추론), CSQA (상식 추론)

주요 결과 (Table 1)

| 모델 | 데이터 | 0-shot CoT | 향상도 |

|---|---|---|---|

| Llama 3.1-8B | CSQA | 31.86 → 39.80 % | +7.9 % |

| Gemma 2-9B | SVAMP | 37.5 → 45.1 % | +7.6 % |

| Gemma 2-9B | CSQA | 41.7 → 48.1 % | +6.4 % |

- 대부분 설정(25/27)에서 기존 prompting 대비 향상, 특히 zero-shot CoT에서 효과가 두드러짐 .

- Prompt-based role-play 대비 더 안정적이며 편차가 작음.

4. 내부 Feature 해석 (Neuronpedia 활용)

| Task | Feature Semantics | 예시 Feature |

|---|---|---|

| Arithmetic | math, teaching, problem solving, logical thinking | 74432, 57569 등 |

| Commonsense | quiz, contestant, reality, focus | 13980, 14140 등 |

- “math”·“teaching” → 교사 역할 반영

- “quiz”·“contestant” → 상식 퀴즈 맥락 반영

- 공통적으로 “thinking”, “focus” 관련 뉴런이 활성화 → step-by-step reasoning을 유도 .

5. Feature 순위별 영향 (Fig. 4)

- 상위 5개 feature 제거 시 성능 급락 → 고순위 feature가 핵심.

- 작은 모델(Gemma 2-2B)은 고순위 feature에 의존적, 큰 모델(Gemma 2-9B)은 완만한 감소 → 용량이 클수록 강건성↑ .

6. 논의 및 시사점

- Prompt 불안정성 원인:

- 작은 모델은 복잡한 지시문 이해 능력 부족

- 구두점·stopword 등 노이즈에 취약

- SRPS 장점:

- 텍스트 입력 변화에 불안정하지 않음

- λ, β 등 파라미터로 세밀한 제어 가능

- SAE latent 공간 내에서 의미적 해석 가능

- 소형 모델에도 적용 가능, instruction-tuning 불필요 .

7. 결론

SRPS는 “역할 수행 정보를 내부 표현 수준에서 주입하는 해석 가능한 조향(steering) 기법”으로, 추가 학습 없이 모델 추론력을 향상시키며 안정성과 해석성을 동시에 확보함.

향후 과제

- 70B 이상 대형 모델로 확장

- 논리·과학·멀티모달 추론 등 다양한 영역 검증 .

요약 한줄로

SRPS = Sparse Autoencoder로 역할 수행 뉴런을 찾아 Residual Stream에 주입함으로써, LLM의 reasoning을 안정적이고 해석 가능하게 강화하는 방법.

방법론 (Methodology)

Sparse Autoencoder Role-Playing Steering (SRPS)

본 논문의 핵심은 role-play prompting이 내부 표현에서 어떤 latent feature를 활성화하는지 분석한 뒤, 해당 feature들을 직접 residual stream에 주입하여 역할 기반 추론을 내부적으로 재현하는 것입니다 .

전체 방법론은 크게 4단계로 구성됩니다.

1. Role-Play Activation 추출

(1) 입력 쌍 구성

각 데이터셋에서 동일한 질문에 대해:

- Positive sample (r⁺): role-play prompt 포함

- Negative sample (r⁻): role-play prompt 미포함

형태의 N개 쌍을 구성합니다 (N=1000 사용) .

예:

"As a math teacher, solve this problem..."

vs.

"Solve this problem..."(2) Residual Stream 추출

각 샘플을 LLM에 통과시켜 특정 layer의 residual stream representation을 추출합니다.

논문에서는:

- Llama3.1-8B → layer 25

- Gemma2-9B → layer 35

- 높은 SAE dimension 사용 (65K~131K)

(3) SAE latent activation 계산

Pretrained Sparse Autoencoder(SAE)를 이용하여 residual stream을 latent space로 인코딩합니다.

각 feature i에 대해:

- : role-play 포함 시 activation

- : role-play 미포함 시 activation

토큰 평균을 계산하되:

- BOS

- punctuation

- stopwords

는 제외합니다 (spurious correlation 방지) .

2. Role-Relevant Feature Selection

role-play에 민감한 feature를 찾기 위해 두 가지 신호를 결합합니다.

(1) Activation Strength 차이

→ role-play로 인해 평균 activation이 얼마나 증가하는지 측정 .

(2) Activation Frequency 차이

threshold 를 설정하고:

→ role-play에서 해당 feature가 더 자주 활성화되는지 측정 .

(3) Sensitivity Score

두 요소를 결합:

- : strength vs frequency 균형 조절

- 상위 k개 feature 선택 (k=15 사용)

3. Steering Vector Construction

선택된 feature들을 SAE decoder weight에서 복원합니다.

SAE decoder:

- d: feature 수

- h: residual stream 차원

각 feature i에 대해:

(1) Weighted Combination

문장 의미는 여러 feature에 분산되어 있으므로 단일 벡터가 아닌 multi-feature 조합 사용 .

- : role-play 시 평균 activation

- s: 최종 steering shift vector

4. Residual Stream Injection

마지막 token의 residual stream에 주입:

- : steering 강도 조절 파라미터

안정성 보정 (Norm Preservation)

L2 norm을 유지하기 위해 normalization 수행:

이는 기존 모델 능력을 유지하면서 방향만 조정하기 위함입니다 .

전체 알고리즘 요약

1. Construct (r⁺, r⁻) prompt pairs

2. Extract residual stream activations

3. Encode with pretrained SAE

4. Compute:

μ_i (strength diff)

δ_i (frequency diff)

I_i = μ_i + β δ_i

5. Select Top-k features

6. Construct steering vector:

s = Σ α_i v_i

7. Inject:

r_new = r + λ s

8. Normalize residual norm핵심 설계 철학

| Prompt 기반 | SRPS |

|---|---|

| 입력 텍스트 변경 | 내부 표현 직접 조작 |

| 불안정 | 파라미터 조절 가능 |

| 해석 어려움 | feature semantic 해석 가능 |

| 소형 모델에 취약 | internal steering으로 보완 |

이 방법의 구조적 의미

SRPS는 다음과 같이 해석할 수 있습니다:

즉,

역할 수행은 단순한 텍스트 효과가 아니라 특정 latent subspace 방향으로의 이동이다.

이 논문은 그 방향을 식별하고, 추출하고, 재주입한 것입니다.

실험 결과 (Experimental Results)

논문은 SRPS(Sparse Autoencoder Role-Playing Steering)가 실제로 LLM 추론 성능을 얼마나 향상시키는지, 그리고 왜 그런지를 세 가지 연구 질문(RQ)으로 분석합니다 .

1. 실험 설정

모델

- Llama3.1-8B

- Gemma2-2B

- Gemma2-9B

데이터셋

- Arithmetic Reasoning

- GSM8K

- SVAMP

- Commonsense Reasoning

- CSQA

평가 설정

- 4-shot CoT

- 1-shot CoT

- 0-shot CoT

비교 대상:

- Original Prompting

- Prompt-based Role-Play

- SAE-based Steering (SRPS)

2. 전체 성능 비교 (RQ1)

핵심 결과

SRPS는 27개 평가 설정 중 25개에서 baseline보다 향상을 보였습니다 .

대표 성능 향상

Llama3.1-8B

| Dataset | 0-shot CoT | Original | SRPS | 향상 |

|---|---|---|---|---|

| CSQA | 31.86% | 39.80% | +7.9% | |

| SVAMP | 59.80% | 63.70% | +3.9% | |

| GSM8K | 40.26% | 44.66% | +4.4% |

Gemma2-9B

| Dataset | 0-shot CoT | Original | SRPS | 향상 |

|---|---|---|---|---|

| SVAMP | 37.50% | 45.10% | +7.6% | |

| CSQA | 41.69% | 48.08% | +6.4% |

Gemma2-2B (소형 모델)

향상폭은 상대적으로 작지만, 대부분 설정에서 성능 개선 확인 .

3. Zero-shot CoT에서 특히 강력

논문의 중요한 관찰:

Steering은 zero-shot CoT에서 가장 큰 효과를 보임

예시:

- Llama3.1-8B (CSQA)

- 4-shot: 72.24 → 72.65 (+0.4%)

- 1-shot: 66.75 → 69.78 (+3%)

- 0-shot: 31.86 → 39.80 (+7.9%)

해석:

- few-shot에서는 이미 CoT exemplar가 reasoning 구조를 제공

- zero-shot에서는 steering이 internal reasoning trigger 역할 수행

4. Prompt-based Role-Play와 비교

Prompt 방식은 불안정:

- 27개 설정 중 12개만 향상

- 특히 zero-shot에서 성능 변동성 큼

반면 SRPS는:

- 평균적으로 더 높은 성능

- 표준편차 낮음

- λ, β로 정밀 제어 가능

→ Steering이 더 안정적이고 controllable

5. 모델 크기별 분석

Llama3.1-8B

가장 큰 향상폭

→ activation perturbation에 민감

Gemma2-9B

이미 baseline 강함

→ 향상폭은 작지만 안정적

Gemma2-2B

고순위 feature에 크게 의존

→ lower-ranked feature 사용 시 급격히 성능 하락

6. Feature Ranking 영향 (RQ3)

Top-k feature를 다른 구간에서 선택했을 때 성능 비교:

- 1–15 (상위)

- 6–20

- 11–25

- 16–30

결과:

- 순위 낮아질수록 성능 감소

- 상위 5개 feature 제거 시 급격한 하락

→ sensitivity score 기반 ranking이 실제로 유효함을 입증

7. SAE Feature 해석 (RQ2)

Neuronpedia 분석 결과:

Arithmetic Task

- “math”

- “teaching”

- “formulas”

- “problem solving”

- “logical thinking”

Commonsense Task

- “quiz”

- “contestant”

- “reality”

- “focus”

공통적으로:

“thinking” 관련 feature가 추론 향상에 핵심

8. 실제 출력 비교

논문 Figure 2 사례:

Before Steering:

- 계산 일부만 사용

- 할인 적용 오류

After Steering:

- 단계별 계산 수행

- 논리적 reasoning 전개

- 정확한 정답 도출

9. 요약 정리

| 분석 항목 | 결과 |

|---|---|

| 전체 설정 | 25/27 개선 |

| 가장 효과적 | Zero-shot CoT |

| Prompt 대비 | 더 안정적 |

| 대형 모델 | 더 robust |

| Feature ranking | Top feature 중요 |

| 해석성 | Neuronpedia로 semantic 확인 가능 |

핵심 메시지

SRPS는 단순히 점수를 올리는 것이 아니라,

역할 수행이 유도하는 internal reasoning subspace를 직접 추출하고 주입함으로써 모델의 사고 경로를 안정적으로 재구성한다.

답글 남기기