[카테고리:] Test-Time Scaling/Training

-

*** Dynamic Cheatsheet: Test-Time Learning with Adaptive Memory (EACL 2026)

1. 문제 정의 (Motivation) 기존 LLM의 핵심 한계: 논문 핵심 주장: “LLM도 inference 과정에서 지속적으로 학습해야 한다” 즉, 2. 핵심 아이디어: Dynamic Cheatsheet (DC) 직관 LLM에게 “치트시트(cheatsheet)”를 만들어주자: 전체 구조 (핵심 loop) 논문 수식으로 표현: (1) 생성 단계 y~i=Gen(xi,Mi)\tilde{y}_i = Gen(x_i, M_i) (2) 메모리 업데이트 Mi+1=Cur(Mi,xi,y~i)M_{i+1} = Cur(M_i, x_i, \tilde{y}_i) 핵심 특징: 3. DC의 두…

-

** Searching for Optimal Solutions with LLMs via Bayesian Optimization (ICLR 2025)

1. 문제의식: LLM 기반 “탐색”의 한계 최근 LLM을 테스트 타임에서 여러 번 샘플링하여 더 나은 해를 찾는 방식(test-time compute scaling)이 주목받고 있습니다. 하지만 기존 방식들은 다음 한계를 가집니다: 접근 한계 Repeated Sampling 탐색 공간 구조를 고려하지 않음 Greedy OPRO exploitation 위주 → local optima에 갇힘 진화 알고리즘 비용 큼 / 정적 전략 난이도 예측 기반…

-

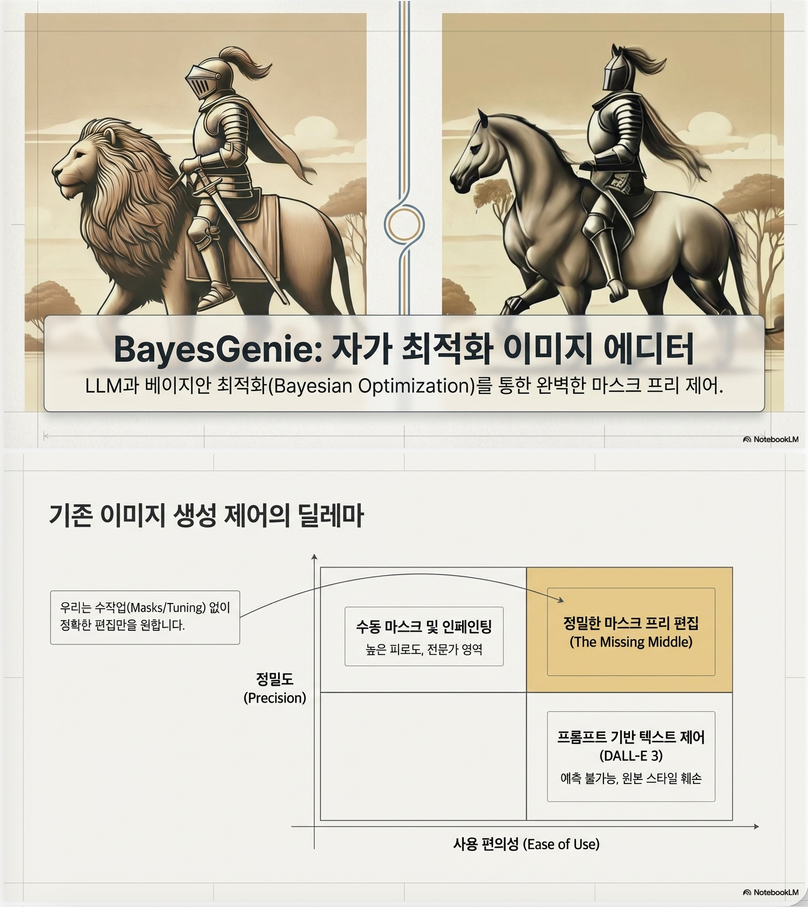

* Bayesian Optimization for Controlled Image Editing via LLMs (ACL 2025 Findings)

본 논문은 BayesGenie라는 프레임워크를 제안합니다. 핵심 아이디어는 다음과 같습니다: LLM을 “Promptist + Evaluator”로 사용하고, Bayesian Optimization(BO)을 통해 diffusion 모델의 CFG 파라미터를 자동 최적화하여 mask 없이 정밀한 이미지 편집을 수행한다. 1. 문제 설정 기존 한계 기존 image editing 방법들의 문제점: 2. BayesGenie 전체 구조 시스템 개요 (논문 Figure 2, p.4) 구조는 다음 4단계로 구성됩니다: ① LLM…

-

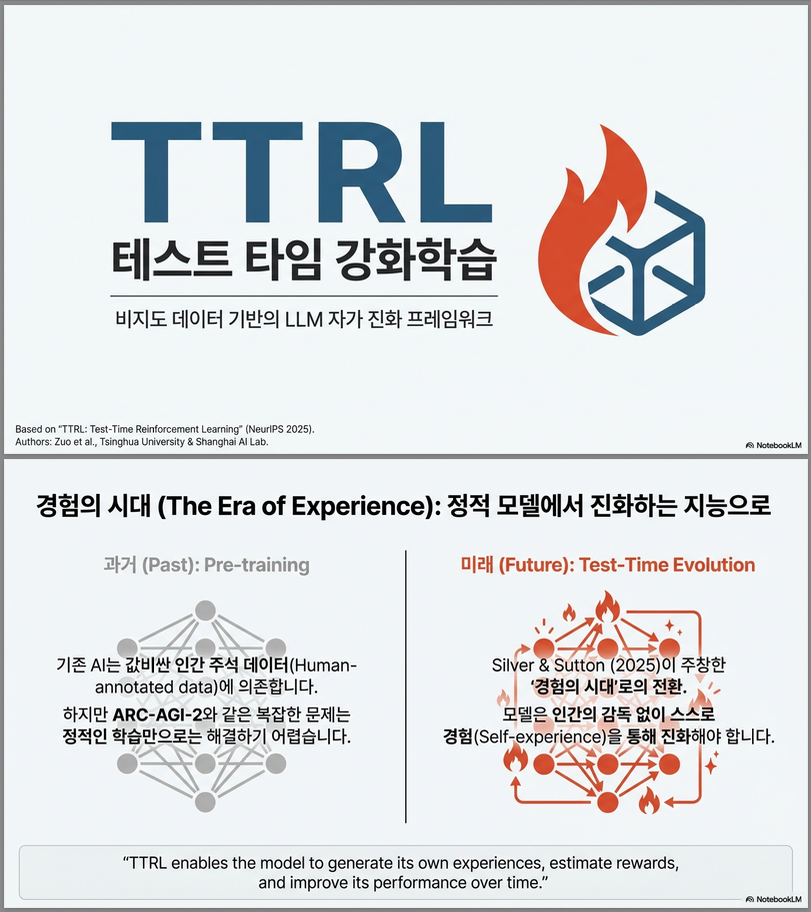

* TTRL: Test-Time Reinforcement Learning (NeurIPS 2025)

논문 **“TTRL: Test-Time Reinforcement Learning” (NeurIPS 2025)**는 라벨이 없는 test 데이터에서 RL을 수행하여 LLM을 test-time에 self-evolve 시키는 방법을 제안합니다 . 아래에서 핵심 아이디어, 수식, 실험 결과, 그리고 왜 작동하는지까지 체계적으로 정리하겠습니다. 1. 문제 설정: Test-Time RL 기존 RL 기반 reasoning 모델 (예: GRPO, PPO 기반 수학 RL)은 ground-truth label이 있는 데이터를 사용합니다. 그러나 TTRL은 다음과…