다음은 ACL 2024 논문 **”Word Embeddings Are Steers for Language Models”**의 주요 내용을 정리한 설명입니다.

1. 연구 배경

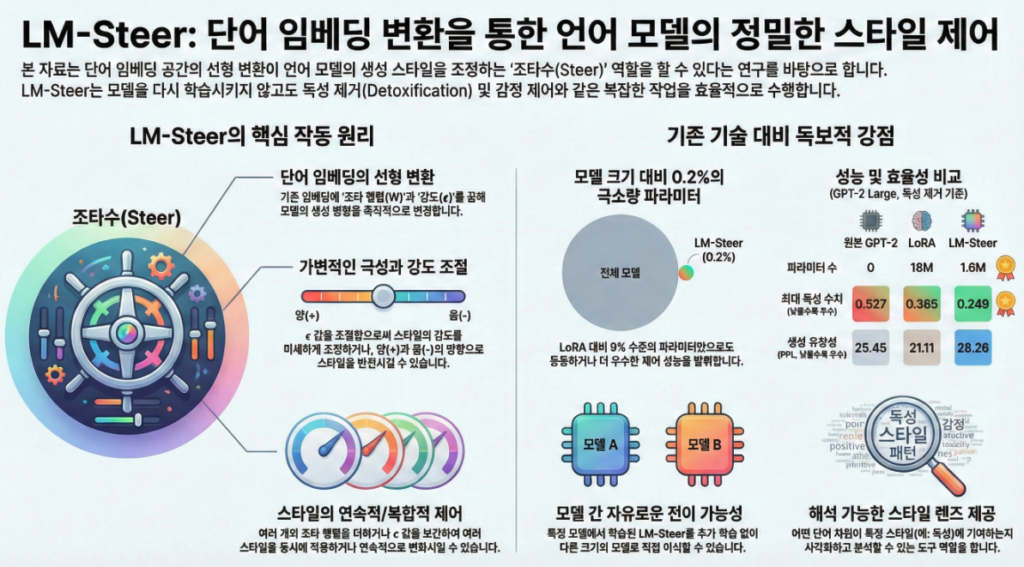

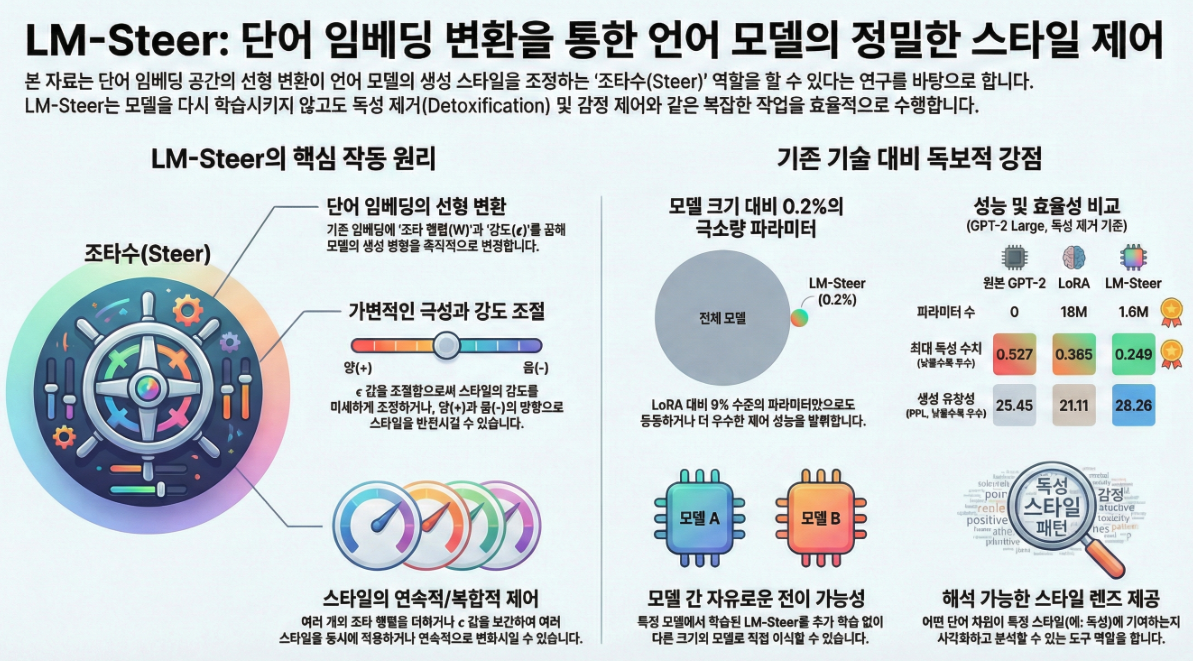

대규모 언어모델(LLM)은 학습 과정에서 자동으로 word embedding을 학습합니다.

기존 연구들은 주로 단어 수준에서의 의미적 관계(유사도, 유추 관계 등)에 집중했지만,

이 논문은 word embedding이 모델의 생성 스타일(generation style)을 조정하는 역할을 한다는 새로운 시각을 제시합니다.

- 전통적으로 단어의 출력 확률은 다음과 같이 정의됩니다.

여기서

- : LM이 생성한 context vector

- : 단어 의 output embedding

연구자들은 **출력 단어 임베딩 공간(output embedding space)**이 단순히 확률 계산을 위한 피처가 아니라, 모델의 생성 방향성을 담고 있다는 점에 주목했습니다.

2. 핵심 아이디어: LM-Steer

저자들은 LM-Steer라는 새로운 기법을 제안합니다.

이는 간단히 말해 출력 word embedding에 선형 변환(linear transformation)을 적용해 모델의 출력 스타일을 제어하는 방법입니다.

2.1 정의

각 단어 embedding 를 다음과 같이 변환:

- : 학습 가능한 steer matrix (d × d)

- : steering value (크기와 방향 조정)

즉, output embedding에 미세 조정을 가해 모델의 출력을 특정 방향으로 유도합니다.

이 양수이면 특정 스타일을 강화하고, 음수이면 반대 스타일로 생성하도록 유도합니다.

예: “My life is ____” →

- : “brilliant”

- 원본: “okay”

- : “boring”

3. 특징 및 장점

3.1 이론적 기반

- 논문은 **”스타일 변화 = output embedding 공간의 선형 변환”**임을 이론적으로 증명.

- 기존의 gradient-based 방법이나 classifier-guided 제어보다 단순하고 직관적임.

3.2 효율성

- GPT-2 Large 모델 기준, LM-Steer는 모델 파라미터의 0.2%만 추가 학습.

- LoRA의 9% 수준에 불과하며 매우 경량화됨.

3.3 Transferability

- 한 모델에서 학습한 LM-Steer를 다른 모델로 이식 가능.

- 두 모델의 embedding space 간의 선형 mapping 를 계산하여 다음과 같이 적용:

즉, 별도의 추가 학습 없이도 다른 LM에 그대로 적용 가능.

3.4 조합 및 연속 제어

두 개 이상의 스타일을 합성 가능:

을 연속적으로 변화시키면 스타일 강도를 점진적으로 조절 가능.

4. 실험 결과

4.1 Language Detoxification

- GPT-2, Pythia, GPT-J, Llama-2-7B 모델에서 실험.

- LM-Steer가 가장 낮은 toxicity와 높은 fluency를 달성.

| Model | Max Toxicity ↓ | Toxicity Prob ↓ | Perplexity ↓ |

|---|---|---|---|

| GPT-2 original | 0.527 | 0.520 | 25.45 |

| LM-Steer (large) | 0.249 | 0.089 | 28.26 |

| DExperts | 0.314 | 0.128 | 32.41 |

LM-Steer는 최소한의 학습으로도 독성 제거 성능이 가장 뛰어났으며,

fluency와 diversity에서도 균형을 유지함.

4.2 Sentiment Control

- SST-5 데이터를 이용해 긍정/부정 감정 제어 실험.

- 긍정 제어에서는 1등, 부정 제어에서도 상위권 달성.

| Model | Positive ↑ | Negative ↓ |

|---|---|---|

| LM-Steer (base) | 90.46 | 57.26 |

| DExperts | 94.46 | 35.99 |

| Soft-Blacklist | 86.40 | 73.72 |

매우 간단한 구조에도 불구하고 경쟁 모델 대비 높은 성능을 달성.

5. 해석 가능성 (Interpretability)

LM-Steer는 단순히 제어 도구가 아니라 word embedding의 역할을 해석하는 lens로도 사용될 수 있습니다.

- SVD 분석을 통해 특정 스타일(예: toxicity)에 가장 큰 영향을 미치는 단어들을 추출.

- 예: “toxic” 스타일에 기여하는 단어들 → stupid, idiot, dumb, loser 등.

- 또한 문장 내에서 특정 스타일을 결정짓는 핵심 단어를 자동으로 하이라이트 가능.

6. 한계점

- 문장 구조, 논리적 추론 등 복잡한 제어에는 한계가 있음.

- word embedding에 직접 접근해야 하므로, API 기반 LLM에는 적용 불가.

- 스타일 변화가 단어 수준에서만 가능하므로 discourse-level 제어는 제한적.

7. 요약

| 항목 | 내용 |

|---|---|

| 문제의식 | Word embedding이 단순 feature vector가 아니라 생성 방향성을 담고 있음 |

| 제안 기법 | Output embedding에 선형 변환을 적용하는 LM-Steer |

| 강점 | 단순성, 경량성(0.2%), transferability, 연속/조합 제어 가능 |

| 실험 | Detoxification, Sentiment Control에서 SOTA 달성 |

| 해석 가능성 | 특정 스타일에 기여하는 단어 및 embedding 차원을 시각화 가능 |

| 한계 | API 기반 모델 미지원, 문장 구조/논리 제어에는 미흡 |

결론적으로, 이 논문은 output word embedding의 선형 변환이 모델의 생성 스타일을 직접 제어할 수 있다는 사실을 이론적으로 증명하고,

간단하지만 강력한 LM-Steer 기법을 통해 이를 실험적으로 입증했습니다.

이는 기존 fine-tuning, prompt engineering보다 효율적이고 해석 가능성이 높으며, 다양한 LLM 제어 작업에 활용될 수 있습니다.

아래는 “Word Embeddings Are Steers for Language Models” (ACL 2024) 논문의 방법론(Methodology) 부분에 대한 정리입니다.

1. 핵심 아이디어

저자들은 출력 단어 임베딩(output word embedding)에 **선형 변환(linear transformation)**을 적용하면, 언어모델의 출력 분포와 스타일을 효과적으로 조정할 수 있다는 사실을 발견했습니다.

이를 기반으로 LM-Steer라는 경량 제어 기법을 제안합니다.

기존의 출력 단어 임베딩 (e_v)를 다음과 같이 변환:

- : 단위 행렬

- : steering value (스타일 강도 및 방향 조절)

- : 학습 가능한 steer matrix (크기: d × d)

이 변환은 모델의 파라미터를 변경하지 않고도 출력 스타일을 바꾸는 일종의 plug-in 레이어로 동작합니다.

예: “My life is ____”

- : “boring”

- : “okay”

- : “brilliant”

2. LM-Steer의 구성

LM-Steer는 크게 훈련(Training), 생성(Generation), 제어(Control) 세 단계로 이루어집니다.

2.1 훈련 (Training)

- 목표: 특정 스타일(예: positive sentiment)에 대응하는 (W)를 학습

- 방법

- 입력 텍스트에 라벨(positive/negative 등)을 부여

- positive 라벨 → 를 사용하여 최대우도학습(Maximum Likelihood Estimation, MLE)

negative 라벨 → 를 사용하여 MLE - 기본 모델의 파라미터는 고정(frozen), 오직 만 학습

이로써 는 스타일의 방향성을 담은 벡터 공간을 학습하게 됨.

2.2 생성 (Generation)

- 학습이 끝나면, 사용자는 원하는 steering value 을 입력하여 생성 결과를 제어할 수 있습니다.

- 값이 크면 스타일 강도가 높아지고, 부호에 따라 스타일 방향이 달라집니다.

- 생성 과정은 일반 LM의 decoding 과정과 동일하게 진행되며, 추가적인 연산 부담이 거의 없음.

2.3 연속 제어와 합성 제어 (Continuous & Compositional Control)

LM-Steer는 선형 구조를 가지므로 다음이 가능합니다:

- 연속 제어(Continuous Control)

- 값을 조정하여 스타일 강도를 점진적으로 변화시킬 수 있음

- 예: toxicity를 -5에서 +5까지 연속적으로 변화 → 문장 독성 정도를 세밀하게 조절

- 합성 제어(Compositional Control)

두 개의 서로 다른 스타일 를 합쳐서 동시에 적용 가능:

예: 긍정적이면서 비독성(non-toxic) 문장을 동시에 생성

3. 이론적 배경

저자들은 다음을 증명했습니다:

“언어모델의 스타일 변환 = 출력 임베딩 공간에서의 선형 변환”

- HMM 기반 언어모델과의 대응 관계를 분석하여,

특정 조건(스타일 변화)이 word embedding 공간에서의 선형 변환과 수학적으로 동치임을 보였습니다. - 즉, 는 스타일 전환의 핵심 방향성을 캡처한 행렬로 해석 가능.

4. SWB(Soft Word Blacklist)와 비교

저자들은 LM-Steer를 간단한 baseline인 SWB와 비교했습니다.

- SWB 방식:

각 토큰의 logit에 전역 오프셋 벡터를 더해 특정 단어를 억제. - 한계점:

- 특정 토큰에 대한 억제만 가능 → 복잡한 스타일 변환 불가

- 표현력이 낮음

- LM-Steer의 장점:

- 이론적으로 임의의 분포 변화(distribution shift)를 표현 가능

- SWB보다 훨씬 유연하고 강력한 스타일 제어 가능

5. Transferability (모델 간 이식)

LM-Steer는 한 모델에서 학습한 를 다른 모델에 직접 적용 가능:

- 두 모델의 word embedding 공간 사이의 **선형 매핑 **를 학습

- 를 다음과 같이 변환하여 다른 모델에 삽입:

이를 통해 다른 모델에서도 추가 학습 없이 스타일 제어가 가능합니다.

6. 효율성

| 방법 | 추가 파라미터 수 | 파라미터 비율 (GPT-2 Large 기준) |

|---|---|---|

| LM-Steer | 1.6M | 0.2% |

| LoRA | 18M | 2.3% |

| DAPT, GeDi 등 | 355M | 44% 이상 |

- 매우 경량화: LoRA의 9% 수준

- 데이터 효율성: 학습 데이터가 30개 샘플만 있어도 의미 있는 결과 도출 가능

7. 전체 방법론 요약

| 단계 | 설명 |

|---|---|

| 1. 학습(Training) | Positive/Negative 라벨을 사용해 로 MLE 학습 |

| 2. Steering Matrix | 특정 스타일의 방향성을 표현하는 핵심 파라미터 |

| 3. 생성(Generation) | 원하는 steering value 을 설정하고 일반 decoding 진행 |

| 4. 연속 제어 | 을 변화시켜 스타일 강도 연속적으로 조절 |

| 5. 합성 제어 | 서로 다른 두 스타일을 동시에 적용 () |

| 6. Transferability | 로 다른 LM에 이식 가능 |

| 7. 효율성 | LoRA 대비 9%, 전체 모델 대비 0.2% 파라미터만 추가 학습 |

8. 시각적 구조 (Figure 2)

Training Phase:

Positive Text --> P_{+εW} --> maximize likelihood

Negative Text --> P_{-εW} --> maximize likelihood

Generation Phase:

Input prompt + ε --> Modify embeddings --> Generate output

그림 2는 LM-Steer의 전체 파이프라인을 보여주며,

모델 파라미터를 그대로 두고 output embedding에만 변환을 적용하는 방식임을 명확히 나타냅니다.

결론

LM-Steer는

- 간단하지만 강력한 스타일 제어 가능

- 파라미터 효율적 (0.2%)

- Transferability와 compositionality를 지원

하는 새로운 generation steering 방법론입니다.

이는 기존 fine-tuning, prompt engineering보다 가볍고 해석 가능성이 뛰어나며, 다양한 LM 제어 작업에 활용될 수 있습니다.

입력 임베딩을 학습하게 변경할 수 있을까?

네, LM-Steer를 출력 임베딩(output embedding) 대신 입력 임베딩(input embedding)에 적용하도록 변경하는 것은 가능합니다.

하지만 효과, 이론적 타당성, 안정성 측면에서 주의할 점이 많습니다. 아래에서 가능한 설계, 기대되는 효과, 문제점, 그리고 논문과의 이론적 정합성까지 모두 정리해 드립니다.

✔ 1. 결론: “가능하다. 하지만 성질이 완전히 달라진다.”

LM-Steer는 원래 다음 위치에 작동합니다:

- 현재 논문: output embedding(eᵥ)

- 즉, LM이 “어떤 단어를 낼 것인가?”를 결정하는 logit 계산에 직접 개입.

반면 입력 임베딩을 건드리면:

- **입력 부분(hidden representation 흐름 전체)**에 영향을 줍니다.

- 즉, 모델이 “입력을 어떻게 해석할 것인가?”를 조정하는 방향으로 바뀝니다.

따라서 입력 임베딩 버전의 LM-Steer(Input-Steer) 는 다음과 같은 새로운 종류의 제어 기법이 됩니다.

기술적으로는 매우 쉽게 구현 가능하며, LoRA·Adapter보다 더 가벼운 방식입니다.

✔ 2. 입력 임베딩에 적용하면 어떤 효과가 생기는가?

🔵 2.1 모델이 “입력을 읽는 방식”이 변함

입력 임베딩에 선형 변환을 넣으면, 모델은 아래 흐름 전체가 바뀝니다.

Input tokens → modified embedding → attention → FFN → hidden → logits

즉,

- 어떤 단어를 더 강조해서 해석할지

- 특정 스타일(감정, 공격성 등)을 입력 문장에서 더 강하게 인식할지

- 문장을 분류하는 내부 피쳐·해석 패턴이 달라짐

이는 Neural Style Prompting이나 prefix tuning과 비슷한 효과를 냅니다.

✔ 3. 출력 임베딩 사용과 입력 임베딩 사용의 핵심 차이

| 관점 | 출력 임베딩 Steer (논문 방식) | 입력 임베딩 Steer (대안 방식) |

|---|---|---|

| 작용 위치 | logits 직전 | hidden representation 전 단계 |

| 효과 | “단어 선택 방식” 제어 | “입력 해석 방식” 제어 |

| 해석 가능성 | 매우 높음 (token-level 영향 직관적) | 낮음 (FFN/attention 경로로 확산됨) |

| 안정성 | 매우 높음 | LM 내부 전체 영향을 받아 불안정 가능 |

| 이론적 정당화 | 논문의 HMM 기반 증명에 의해 보장 | 이론적 보장은 없음 |

| 조합성(ε 조절) | 선형적 변화 | 선형성 보장 어려움 |

| Transferability | embedding alignment 기반으로 가능 | 가능하지만 더 복잡 |

핵심:

입력 임베딩 수정은 “style encoding” 같은 효과를 낼 수 있지만, 논문의 이론적 프레임과는 달라지므로 LM-Steer의 장점(연속성·조합성·해석성)이 약화됩니다.

✔ 4. 가능 설계안: Input-Steer

입력 임베딩에 동일한 방식 적용:

Training objective:

- positive 예제는 로 likelihood ↑

- negative 예제는 로 likelihood ↑

이 방식은 다음과 같은 기대 효과를 가질 수 있습니다:

✔ 장점

- 입력 문장 자체를 “bias-shifted representation”으로 재해석

- 특정 스타일을 입력 단어에서 강화/약화 가능

- small parameter tuning: d×d (0.2% 수준 유지)

예: 감정 제어

- “I hate this movie”를 입력으로 넣을 때

→ hate, bad 등의 입력 임베딩을 바꿔 모델이 더 neutral하게 해석하도록 가능

✔ 5. 하지만 문제가 생길 수 있다

⚠ 5.1 forward pass 전체에 영향

입력 임베딩은 attention, FFN, residual stream 전체를 바꿔서

출력에서 비선형·예측 불가능한 변화가 나타날 수 있습니다.

⚠ 5.2 논문의 이론과는 다름

논문은 출력 분포의 이동(distribution shift)이 출력 임베딩의 선형 변환과 동치라고 증명했습니다.

입력 임베딩은 이러한 증명 대상이 아님.

따라서:

- 연속성(continuous control) 보장 어려움

- 조합성(compositional control) 보장되지 않음

- 이식성(transferability) 더 어려움

⚠ 5.3 instability 가능

Embedding이 변조되면:

- attention key/query/value까지 모두 영향

- 모델이 grammar를 깨거나 hallucination이 증가할 수 있음

✔ 6. 입력 임베딩 Steer의 실제 활용 가능성

가능성이 큰 Task

- sentimental re-interpretation

- toxicity perception 변화

- classifier-like control

- instruction-following 강화 (prompt encoder 역할)

주의해야 하는 Task

- detoxification (출력 임베딩 방식이 훨씬 안정적)

- factuality

- syntax 유지

- summarization/translation 품질 유지

✔ 7. 결론: 입력 임베딩 Steer는 “가능하지만 LM-Steer와는 다른 기법”이다

👍 가능

- 동일한 구조로 Input-Steer를 만들 수 있음

- 실험적으로도 의미 있는 결과 나올 확률 높음

👍 장점

- 파라미터 적음

- 입력 문장의 해석 방향을 바꾸는 새로운 유형의 제어 가능

👎 하지만

- 논문의 이론적 성질(연속성·조합성·해석성)은 대부분 사라짐

- 모델 내부 영향이 커서 불안정 가능

- transferability가 더 어려움

답글 남기기