[태그:] HISP

-

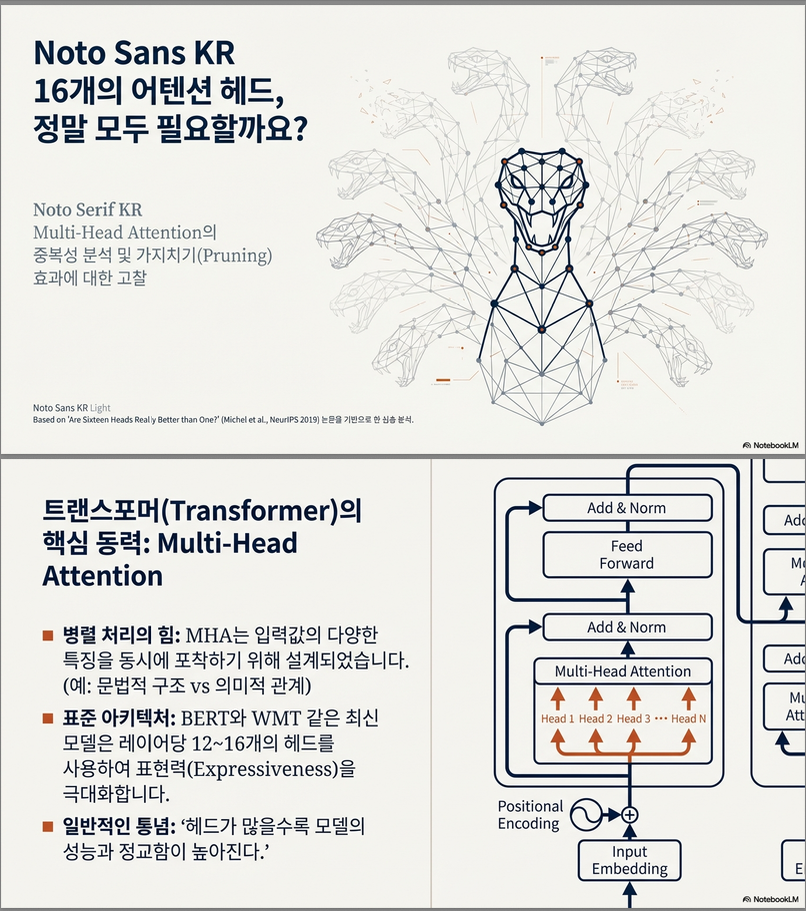

* Are Sixteen Heads Really Better than One? (NeurIPS 2019)

이 논문은 **Transformer의 multi-head attention(MHA)가 정말로 많은 head를 필요로 하는가?**라는 매우 직관적인 질문을 실증적으로 파고든 고전적인 분석 논문입니다. 아래에서 문제의식 → 방법론 → 실험 결과 → 핵심 해석 → 이후 연구에 미친 영향 순서로 정리해 드릴게요. (논문: Are Sixteen Heads Really Better than One?, NeurIPS 2019) 1. 문제의식 (Motivation) Transformer에서 multi-head attention은 다음과 같은 이유로…