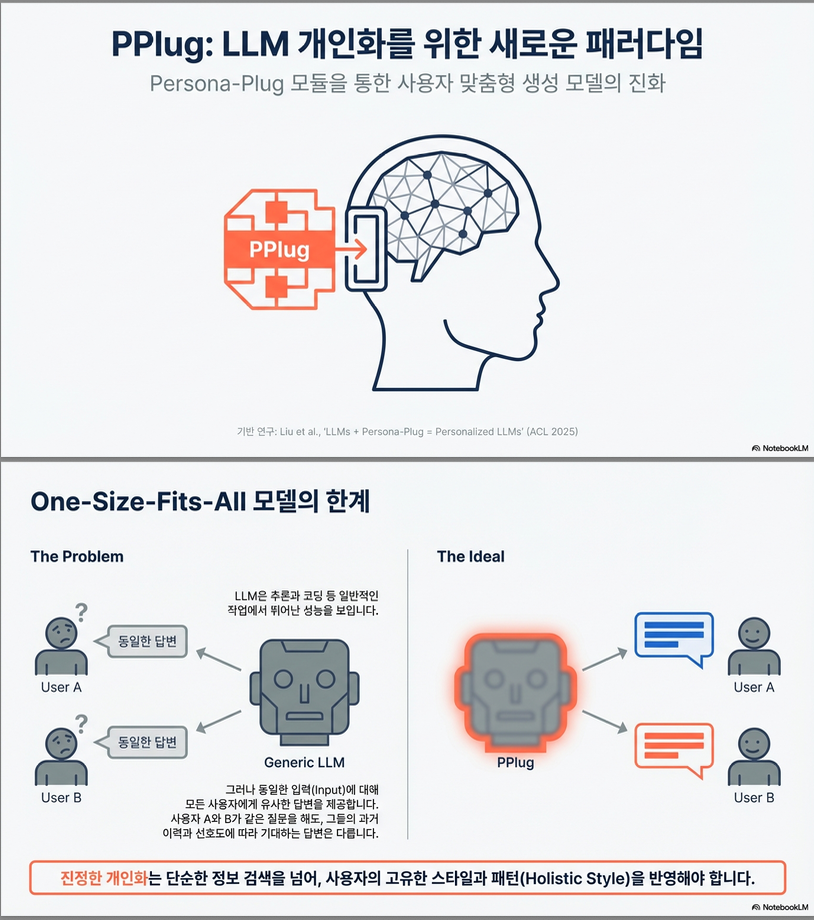

아래에서는 **ACL 2025 논문 「LLMs + Persona-Plug = Personalized LLMs」**의 관련 연구, 방법론, 실험 결과를 논문의 구조와 저자들의 주장에 맞춰 체계적으로 정리합니다. 설명은 왜 기존 접근이 한계가 있었는지 → 무엇을 새로 제안했는지 → 실험으로 무엇이 검증되었는지의 흐름으로 구성했습니다.

1. 관련 연구 (Related Work)

논문은 LLM 개인화(personalization) 접근을 크게 두 계열로 정리합니다.

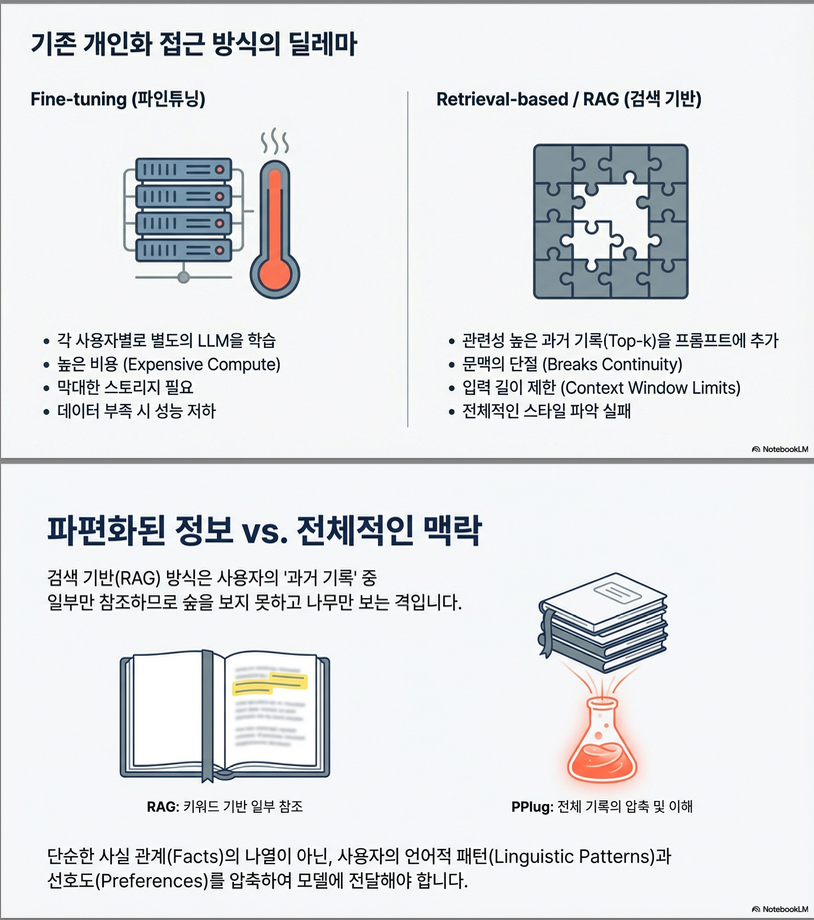

1.1 Fine-tuned Personalized LLMs (사용자별 미세조정)

- 아이디어: 사용자별 데이터로 LLM을 직접 fine-tuning (또는 LoRA 등 PEFT).

- 대표 연구

- OPPU (Tan et al., 2024b): 사용자별 LoRA

- 사용자 클러스터링 후 그룹별 튜닝 (Tan et al., 2024a)

- 사용자별 language head 분리 (Zhuang et al., 2024)

- 한계

- 사용자마다 모델/파라미터 유지 → 막대한 비용

- 사용자 히스토리가 짧으면 과적합 / 성능 저하

- 실서비스 배포가 어려움

1.2 Retrieval-based Personalized LLMs (RAG 계열)

- 아이디어: 사용자 히스토리에서 현재 입력과 관련된 과거 행동을 retrieval → in-context demonstration으로 제공

- 대표 연구

- LaMP benchmark 계열 (Salemi et al., 2024a,b)

- BM25, Contriever, RL/KD 기반 retriever 최적화

- 한계

- 국소적 관련성에만 집중 → **사용자 전체 스타일/습관(holistic pattern)**을 포착하기 어려움

- 일부 히스토리만 선택 → 개인성의 불연속성

- 히스토리 전체를 서버에 저장해야 하는 프라이버시 이슈

🔎 핵심 문제의식

“개인화에는 특정 과거 사례보다 사용자의 전반적 언어 습관과 스타일이 더 중요하다.”

2. 방법론 (Methodology):

Persona-Plug (PPlug)

2.1 전체 아이디어

- 핵심 개념: *LLM은 고정(frozen)하고, 사용자 히스토리 전체를 요약한 **단 하나의 개인 임베딩(personal embedding)*을 입력에 붙여 사용

- 목표

- 사용자별 모델 튜닝 ❌

- retrieval로 일부 히스토리만 쓰는 방식 ❌

- → plug-and-play 개인화 임베딩 ✔

2.2 User Behavior Encoder

- 각 사용자 히스토리 를 encoder 기반 모델로 임베딩

- 현재 입력 도 동일한 임베딩 공간으로 인코딩

- 구현:

- BGE-base-en-v1.5 사용

- 히스토리 encoder는 freeze, input encoder만 미세조정

- 이유:

- bi-encoder는 문장/문서의 스타일·의미 압축에 효과적

- 경량 모델 → 효율적 학습/추론

2.3 Input-aware Personal Aggregator (핵심 기여)

단순 평균 ❌ → 입력 의존 가중 합(attention) ✔

- 현재 입력과 히스토리 임베딩 간 dot-product로 중요도 계산:

- 개인 임베딩:

- 특징

- retrieval처럼 관련성은 반영

- ❗ 모든 히스토리를 사용 → holistic persona 유지

- Proj는 2-layer MLP로 LLM embedding space에 정렬

2.4 LLM 입력 결합 방식

LLM 입력 시퀀스:

- I: Instruction embedding (학습 가능)

- : 사용자 개인 임베딩

- LLM 자체는 완전히 고정

- 학습되는 것:

- input encoder

- projector

- instruction embedding

👉 결과적으로 LLM 파라미터 0개 수정 + 사용자별 개인화 달성

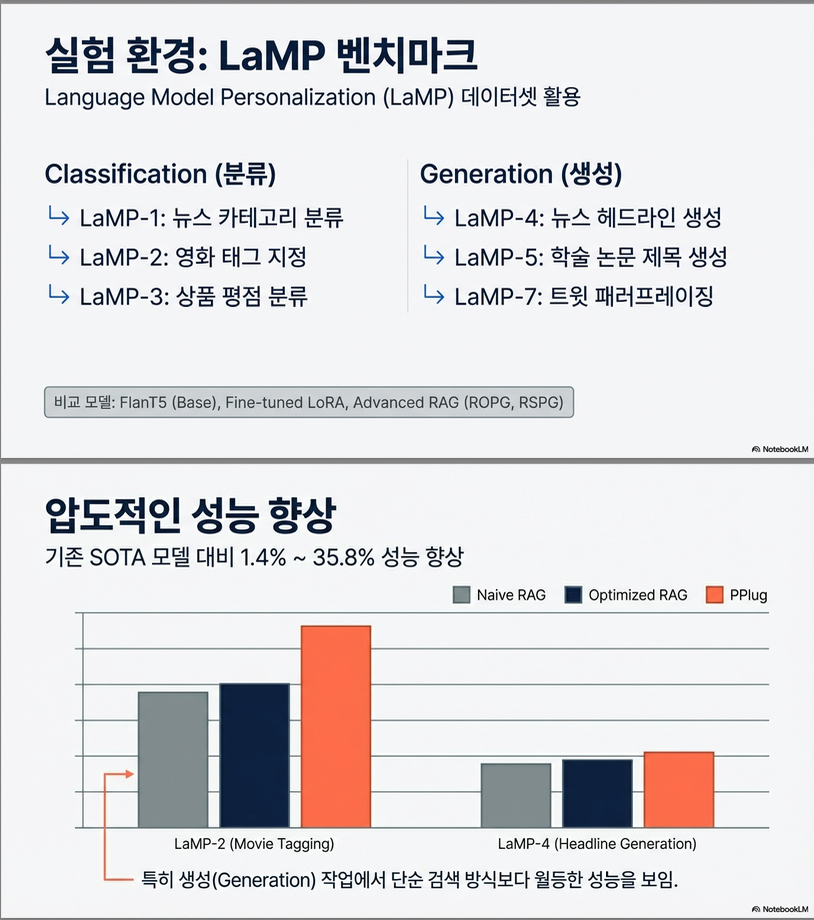

3. 실험 결과 (Experiments)

3.1 실험 설정

- Benchmark: LaMP (6개 태스크)

- 분류(LaMP-1/2/3)

- 생성(LaMP-4/5/7)

- LLM: Flan-T5-XXL (11B)

- 비교 방법

- Non-personalized (ad-hoc)

- Fine-tuned personalization (LoRA 기반, 기존 결과 인용)

- Naive retrieval (BM25, Recency, Contriever)

- Optimized retrieval (ROPG, RSPG 계열)

3.2 메인 성능 (Table 1)

- PPlug이 모든 태스크에서 최고 성능

- 상대 개선폭

- 기존 최고 retrieval-based 방법 대비 +1.4% ~ +35.8%

- 관찰 포인트

- Fine-tuning은 히스토리 부족으로 효과 제한

- Retrieval은 효과 있으나 불안정

- PPlug은 안정적이고 일관되게 우수

3.3 Ablation Study

- Input-aware aggregation 제거

- 성능 하락 → 입력 의존 가중치의 중요성 입증

- Instruction embedding 제거

- 여전히 baseline보다 좋음

- 하지만 성능 감소 → task-level 정보와 persona 분리의 효과 확인

3.4 History Selection 분석 (중요한 인사이트)

- 상위 K개 히스토리만 사용 → 성능 감소

- 모든 히스토리를 aggregation하는 것이 가장 효과적

- 논문 메시지: “개인화는 retrieval 문제가 아니라 representation 문제”

3.5 Retrieval과의 결합

- PPlug + Retrieval

- coarse-grained persona (PPlug)

-

- fine-grained context (retrieval)

- 대부분 태스크에서 추가 성능 향상

- → hybrid personalization 가능성 제시

4. 핵심 정리 (Reviewer 관점 요약)

| 관점 | 평가 |

|---|---|

| 문제정의 | retrieval 기반 개인화의 구조적 한계를 정확히 지적 |

| 방법론 | 단순하지만 개념적으로 강력한 persona embedding |

| 기술 난이도 | 낮아 보이지만 설계는 매우 정교 |

| 실용성 | ⭐⭐⭐⭐⭐ (LLM 파라미터 0 수정) |

| 연구적 메시지 | “개인화 = 히스토리 선택 ❌, 히스토리 압축 ✔” |

답글 남기기