[카테고리:] Data Contamination

-

Detecting Pretraining Data from Large Language Models (ICLR 2024)

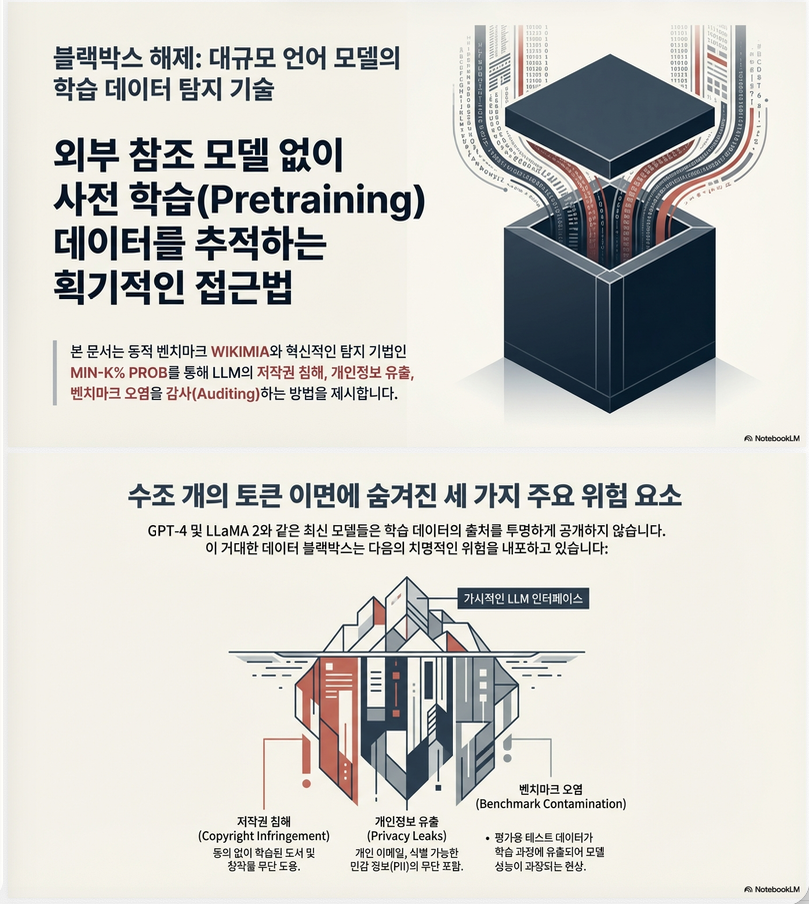

1. 문제 제기: Pretraining Data Detection LLM은 어떤 데이터로 학습되었는지 공개되지 않는 경우가 많음. 이로 인해 다음과 같은 문제가 발생: 따라서 논문은 다음 질문을 다룸: Black-box LLM에 대해, 주어진 텍스트가 pretraining 데이터에 포함되었는지 판별할 수 있는가? 이는 Membership Inference Attack (MIA)의 pretraining 버전 문제이다. 2. 기존 MIA와의 차이점 (핵심 난점) 논문은 기존 fine-tuning MIA와 달리…

-

An Open-Source Data Contamination Report for Large Language Models (EMNLP 2024 Findings)

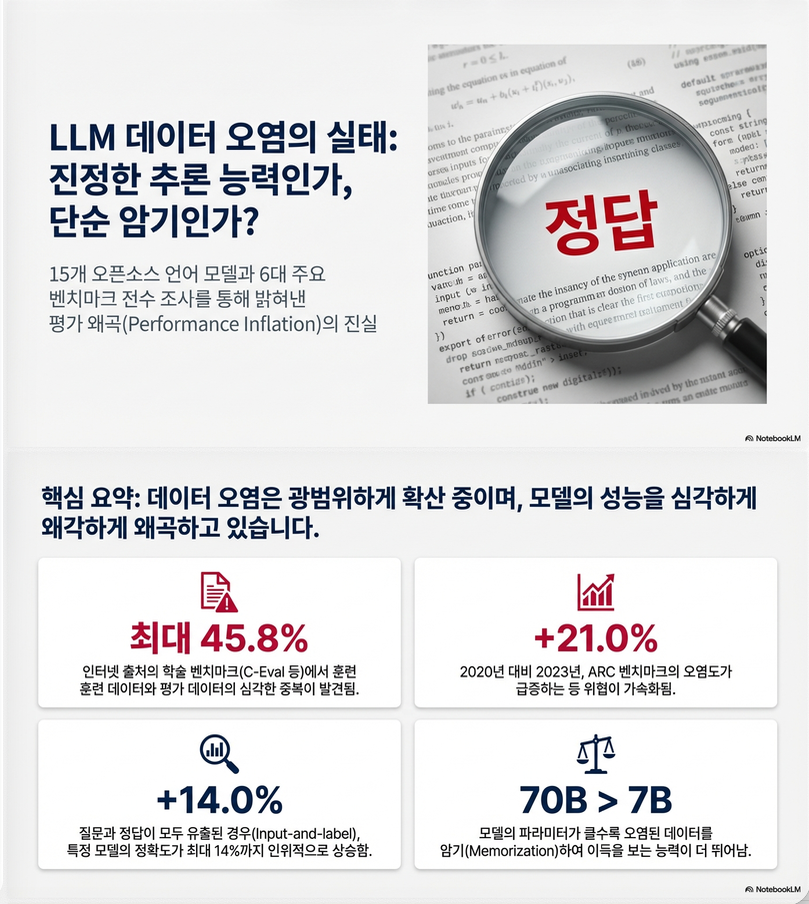

1. 문제 정의 및 연구 배경 Data Contamination이란? 테스트셋의 일부 샘플이 LLM의 pre-training 데이터에 이미 포함되어 있는 현상을 의미합니다. 이 경우 모델은 **일반화(generalization)**가 아니라 **암기(memorization)**로 정답을 맞출 수 있습니다. 논문에서는 contamination을 두 유형으로 구분합니다: (p.2 정의 부분 참고 ) 2. 기존 연구의 한계 기존 contamination 분석은: 즉, 투명성 부족 문제가 존재합니다. 3. 제안 방법 (핵심…

-

* DCR: Quantifying Data Contamination in LLMs Evaluation (EMNLP 2025)

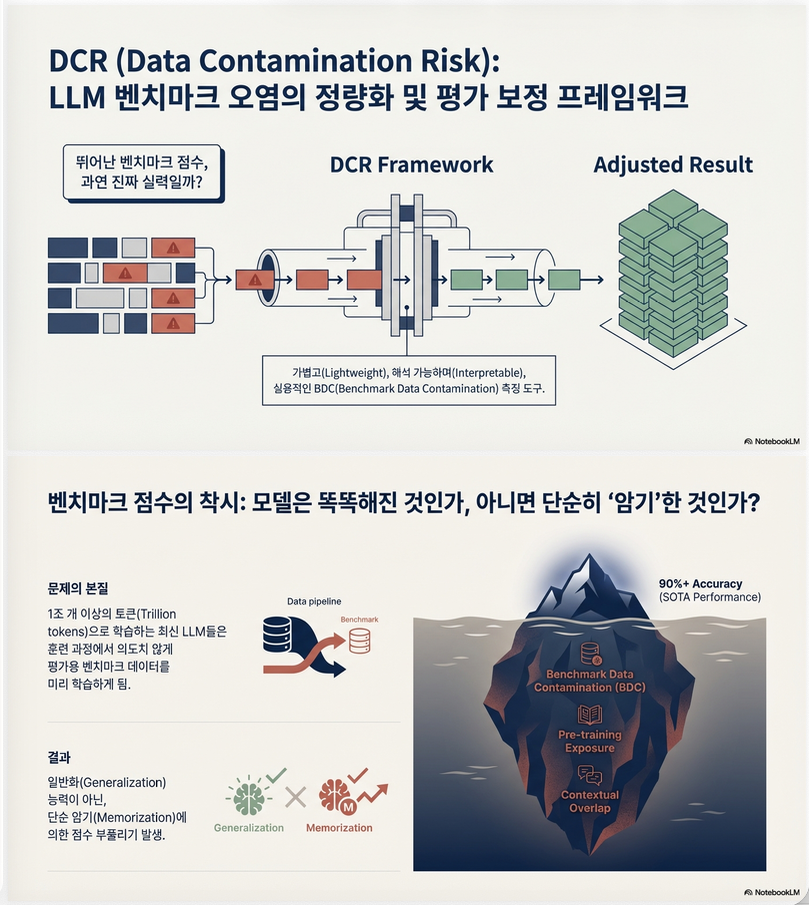

이 논문은 LLM 평가에서의 Benchmark Data Contamination (BDC) 문제를 정량적으로 측정하고, 오염을 반영하여 성능을 보정하는 DCR (Data Contamination Risk) 프레임워크를 제안합니다. 핵심 메시지는 다음과 같습니다: LLM의 높은 benchmark 성능이 실제 일반화 능력이 아니라, 사전 학습 중 평가 데이터 노출(오염) 때문일 수 있다. 따라서 성능을 그대로 믿어서는 안 되며, 오염을 정량화하고 보정해야 한다. 1. 문제 정의:…

-

* Establishing Trustworthy LLM Evaluation via Shortcut Neuron Analysis (ACL 2025)

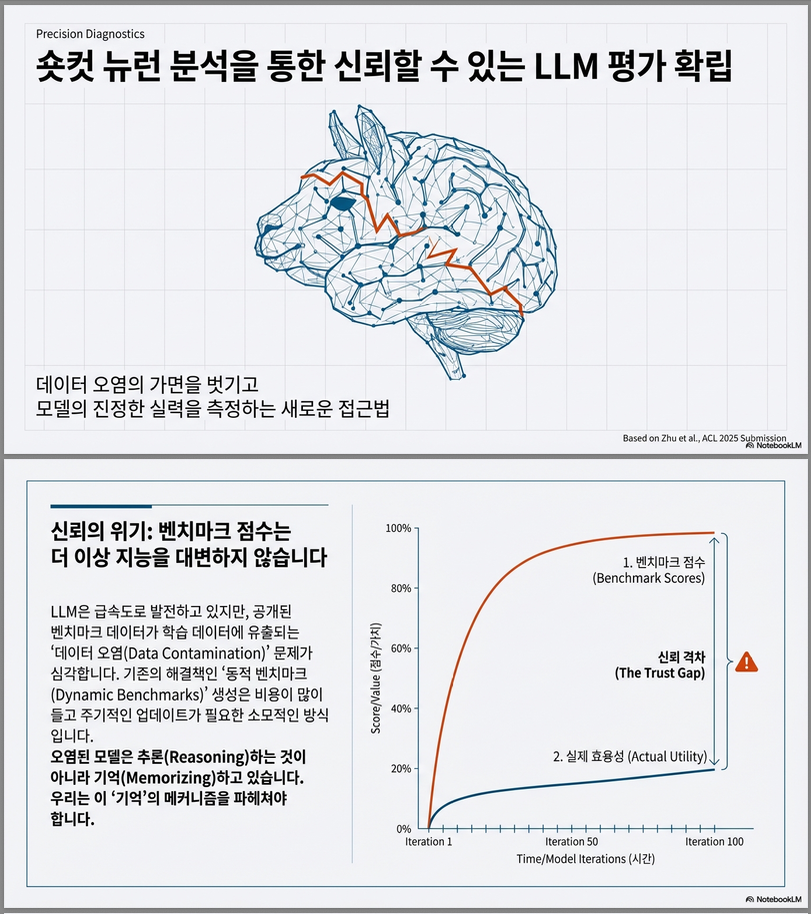

논문 “Establishing Trustworthy LLM Evaluation via Shortcut Neuron Analysis” (ACL 2025) 은 데이터 오염(data contamination) 문제로 인해 LLM 평가의 신뢰성이 손상되는 문제를 해결하기 위해, 모델 내부의 “지름길 뉴런(shortcut neurons)”을 분석하고 억제함으로써 공정하고 신뢰할 수 있는 평가를 수행하는 방법을 제안한 연구입니다. 아래는 주요 내용 요약입니다. 연구 배경 및 문제의식 따라서 이 논문은 모델 내부의 원인, 즉…